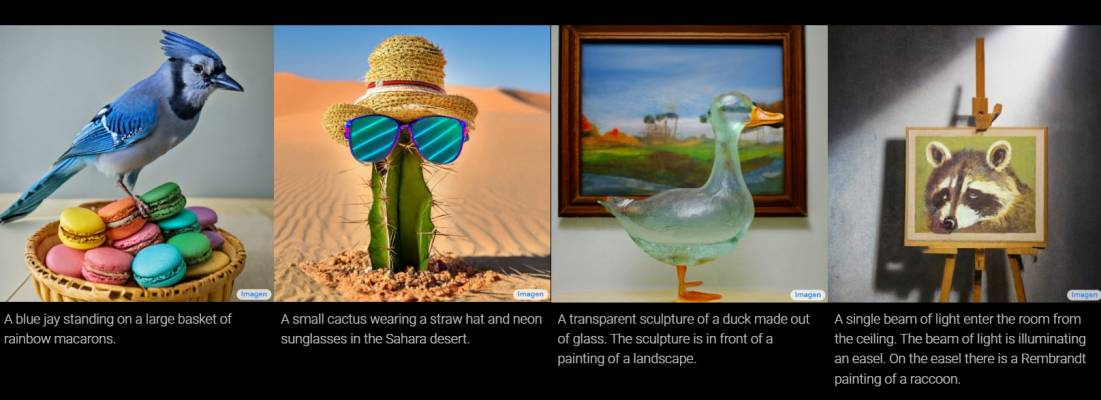

Ето нещо успокояващо, по което да помислите: изследователите, използващи изкуствен интелект с машинно обучение, често не знаят точно как техните алгоритми решават проблемите, с които са натоварени. Вземете например AI, който може да идентифицира расата на човек чрез рентгенови лъчи, или AI на Facebook, който започна да развива свой собствен език. Към тях може да се присъедини познатият генератор на текст към изображение DALLE-2.

Докторантът по компютърни науки Янис Дарас забеляза, че системата DALLE-2, която създава изображения въз основа на подкана за въвеждане на текст, при определени обстоятелства ще върне безсмислени думи като текст.

„Известно ограничение на DALLE-2 е, че се мъчи с текста“, пише той в статия, публикувана в сървъра за предпечат Arxiv. „Например текстови подкани като „Изображение на думата самолет“ често водят до генерирани изображения, които изобразяват безсмислен текст.“

„Открихме, че този така произведен текст не е случаен, а по-скоро разкрива скрит речник, който моделът изглежда е разработил вътрешно. Например, когато се захранва с този безсмислен текст, моделът често генерира самолети.“

В една илюстрация, публикувана в Twitter, Дарас обяснява, че когато бъде помолен да изготви субтитри на разговор между двама фермери, машината показва, че говорят, но балончетата са пълни с нещо, което изглежда като пълна глупост. На Дарас обаче му хрумнала мисълта да върне тези глупави думи обратно в системата, за да види дали AI им е присвоил собствените си значения. Когато направил това, той установил, че думите изглежда имат собствено значение за AI: фермерите говорят за зеленчуци и птици.

Ако Дарас е прав, той вярва, че това би имало последици за сигурността на генератора на текст към изображение.

„Първият проблем със сигурността е свързан с използването на тези безсмислени подкани като съревнователни атаки на задната врата или начини за заобикаляне на филтъра“, пише той в своя документ. „Понастоящем системите за обработка на естествен език филтрират текстовите подкани, които нарушават правилата на политиката, и безсмислените подкани могат да се използват за заобикаляне на тези филтри.“

„По-важното е, че абсурдните подсказки, които постоянно генерират изображения, поставят под въпрос нашето доверие в тези големи генеративни модели.“

Въпреки че е доказано, че други алгоритми създават свои собствени езици, този документ все още не е рецензиран и други изследователи поставят под въпрос твърденията на Дарас. Анализаторът Бенджамин Хилтън помоли генератора да покаже два кита, които говорят за храна, със субтитри. След като първите няколко резултата не върнаха дешифрируем текст, той предполага, че предишните резултати са били по-скоро случайни.

Освен това добавянето на термини като „3D изобразяване“ към други фрази дава различни резултати, което предполага, че те не означават постоянно едно и също нещо.

Все пак Хилтън добави, че фразата „Apoploe vesrreaitais“ връща изображения на птици всеки път, „така че със сигурност има нещо в това“.

Снимка: Pikrepo

Виж още: Новото безжично зареждане на Xiaomi е пет пъти по-бързо от това на iPhone 12 (ВИДЕО)