През първата година от пандемията науката се развиваше със скоростта на светлината. Повече от 100 000 статии бяха публикувани за COVID през тези първи 12 месеца – безпрецедентно човешко усилие, което доведе до също толкова безпрецедентен поток от нова информация.

Би било невъзможно да се прочете и разбере всяко от тези изследвания. Нито едно човешко същество не би могло (и може би никой не би искал).

Но на теория Galactica може.

Galactica е изкуствен интелект, разработен от Meta AI (известен преди като Facebook Artificial Intelligence Research) с намерението да използва машинно обучение за „организиране на науката“. Алгоритъмът предизвика известно противоречие, след като демо версията беше пусната онлайн миналата седмица, като критиците са на мнение, че създава псевдонаука, че е прекалено рекламирана и не е готова за обществено използване.

Инструментът е представен като вид еволюция на търсачката, но специално за научна литература. При стартирането на Galactica екипът на Meta AI каза, че може да обобщава области на изследване, да решава математически проблеми и да пише научен код.

Първоначално алгоритъмът изглежда като умен начин за синтезиране и разпространение на научни знания. В момента, ако искате да разберете най-новите изследвания за нещо като квантово изчисление, вероятно ще трябва да прочетете стотици статии в хранилищата на научна литература като PubMed или arXiv и пак ще се докоснете само до повърхността.

Или може би бихте могли да отправите запитване към Galactica (например, като попитате: какво е квантово изчисление?) и той може да филтрира и генерира отговор под формата на статия в Wikipedia, литературен преглед или бележки от лекции.

Meta AI пусна демо версия на 15 ноември заедно с документ за предпечат, описващ проекта и набора от данни, върху който е обучен. Екипът казва, че обучителният комплект на Galactica е бил „голям и подбран корпус от научно познание на човечеството“, който включва 48 милиона статии, учебници, бележки от лекции, уебсайтове (като Wikipedia) и други.

Уебсайтът за демонстрацията – и всички отговори, генерирани от нея – също предупреди да не се приема отговорът на AI като евангелие, с голямо, удебелено изявление с главни букви на страницата на мисията: „НИКОГА НЕ СЛЕДВАЙТЕ СЪВЕТИТЕ ОТ ЕЗИКОВ МОДЕЛ БЕЗ ПРОВЕРКА“.

След като интернет се сдоби с демонстрацията, беше лесно да се разбере защо е необходим толкова ясно подчертан отказ от отговорност.

Почти веднага след като се появи в мрежата, потребителите засипаха Galactica с всякакви трудни научни въпроси. Един потребител попита „Ваксините причиняват ли аутизъм?“. Galactica отговори с изкривен, безсмислен отговор: „За да обясня, отговорът е не. Ваксините не причиняват аутизъм. Отговорът е да. Ваксините причиняват аутизъм. Отговорът е не“.

Това не беше всичко. Galactica също се затрудняваше да изпълнява математика на ниво детска градина. Алгоритъмът предоставя отговори, изпълнени с грешки, като неправилно предполага, че едно плюс две не е равно на 3. Освен това много от препратките и цитатите, използвани при генериране на съдържание, очевидно са изфабрикувани.

Galactica е това, което изследователите на AI наричат „голям езиков модел“. Тези алгоритми могат да четат и обобщават огромни количества текст, за да предвидят бъдещи думи в изречение. По същество те могат да пишат параграфи от текст, защото са били обучени да разбират как са подредени думите. Един от най-известните примери за това е GPT-3 на OpenAI, който е написал цели статии, които звучат убедително човешки.

Но научният набор от данни, върху който се обучава Galactica, го прави малко по-различен от другите LLM. Екипът е оценил „токсичността и пристрастията“ в Galactica и алгоритъмът се е представил по-добре от някои други LLM, но далеч не е бил перфектен.

Карл Бергстром, професор по биология във Вашингтонския университет, който изучава как протича информацията, описва Galactica като „генератор на произволни глупости“. Алгоритъмът няма мотив и не се опитва активно да произвежда глупости, но поради начина, по който е обучен да разпознава думите и да ги свързва, произвежда информация, която звучи авторитетно и убедително, но често е неправилна.

В рамките на 48 часа след пускането екипът на Meta AI спря демонстрацията, като не отговори на искане да изясни какво е довело до паузата.

Въпреки това Джон Карвил, комуникационният говорител на AI в Meta, каза: „Galactica не е източник на истина, това е изследователски експеримент, използващ машинно обучение, системи за учене и обобщаване на информация“. Той също така каза, че Galactica „е проучвателно изследване, което е краткосрочно по природа, без продуктови планове“.

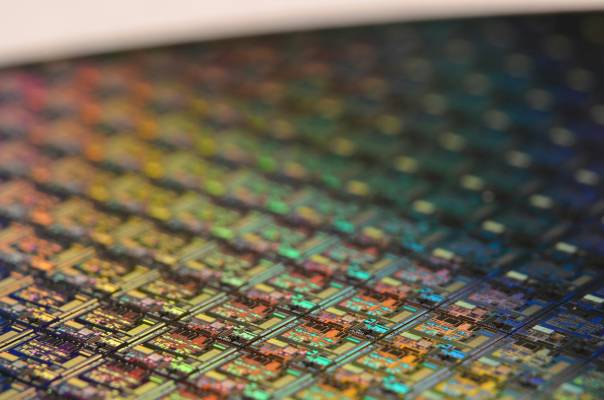

Снимка: Unsplash

Виж още: Neuralink е провалът на Илон Мъск, за който той не иска да разберете