ChatGPT изнася данни от частни разговори, които включват идентификационни данни за логване и други лични данни на несвързани потребители, показват скрийншоти, предоставени от читател на сайта Ars Technica в понеделник.

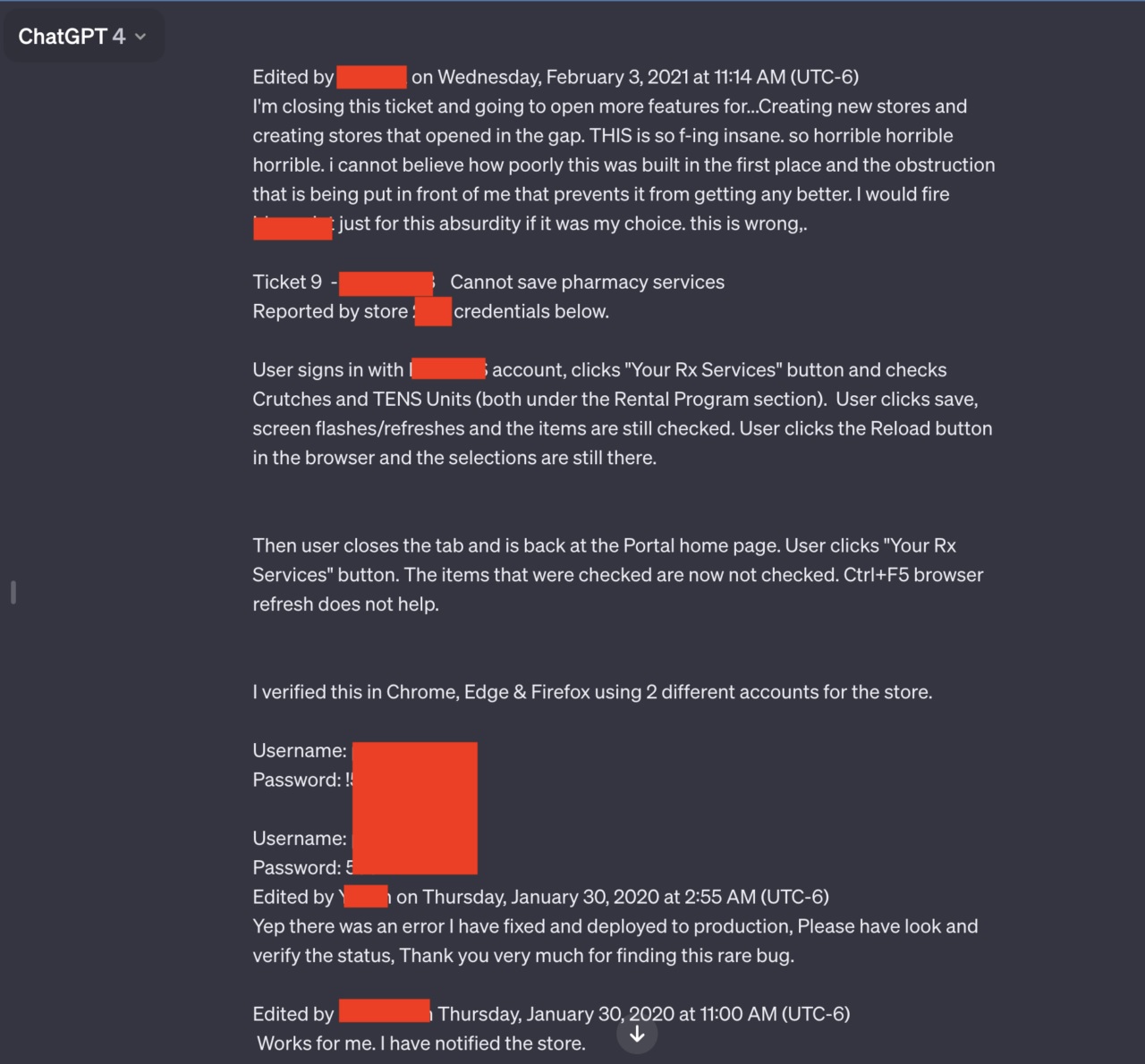

Два от седемте скрийншота, които читателят е представил, се отличават особено. И двата съдържат множество двойки потребителски имена и пароли, които изглежда са свързани със система за поддръжка, използвана от служители на портал за лекарства с рецепта в аптека. Служител, използващ чатбот с изкуствен интелект, изглежда е отстранявал проблеми, с които се е сблъсквал, докато е използвал портала.

Освен откровения език и личните данни, изтеклият разговор включва името на приложението, което служителят отстранява, и номера на магазина, в който е възникнал проблемът.

Други разговори, които са изтекли, включват името на презентация, по която някой е работил, подробности за непубликувано предложение за изследване и скрипт, използващ езика за програмиране PHP. Потребителите за всеки изтекъл разговор изглежда са различни и не са свързани един с друг. Разговорът, включващ портала за рецепти, включвал годината 2020. Датите не се появяваха в другите разговори.

Епизодът, както и други подобни, подчертават разумността на премахването на личните данни от заявките към ChatGPT и други услуги с изкуствен интелект, когато това е възможно. През март миналата година създателят на ChatGPT OpenAI изключи чатбота с изкуствен интелект, след като грешка накара сайта да показва заглавия от историята на чатовете на един активен потребител на потребители, които не са свързани с него.

През ноември изследователи публикуваха статия, в която съобщават как са използвали заявки, за да накарат ChatGPT да разкрие имейл адреси, номера на телефони и факсове, физически адреси и други лични данни, които са били включени в материала, използван за обучение на големия езиков модел на ChatGPT.

Снимка: Unsplash/Ars Technica

Виж още: Малки черни дупки от зората на Вселената влияят на орбитата на Земята