–ö–ł—ā–į–Ļ—Ā–ļ–ł –ł–∑—Ā–Ľ–Ķ–ī–ĺ–≤–į—ā–Ķ–Ľ–ł —ā–≤—ä—Ä–ī—Ź—ā, —á–Ķ —Ā–į –ĺ—ā–ļ—Ä–ł–Ľ–ł –ī–ĺ–ļ–į–∑–į—ā–Ķ–Ľ—Ā—ā–≤–į, —á–Ķ –≥–ĺ–Ľ–Ķ–ľ–ł—ā–Ķ –Ķ–∑–ł–ļ–ĺ–≤–ł –ľ–ĺ–ī–Ķ–Ľ–ł (LLM) –ľ–ĺ–≥–į—ā –ī–į —Ä–į–∑–Ī–ł—Ä–į—ā –ł –ĺ–Ī—Ä–į–Ī–ĺ—ā–≤–į—ā –Ņ—Ä–ł—Ä–ĺ–ī–Ĺ–ł –ĺ–Ī–Ķ–ļ—ā–ł –ļ–į—ā–ĺ —á–ĺ–≤–Ķ—ą–ļ–ł—ā–Ķ —Ā—ä—Č–Ķ—Ā—ā–≤–į. –Ę–ĺ–≤–į —Ā–Ņ–ĺ—Ä–Ķ–ī —ā—Ź—Ö —Ā–Ķ —Ā–Ľ—É—á–≤–į —Ā–Ņ–ĺ–Ĺ—ā–į–Ĺ–Ĺ–ĺ, –ī–ĺ—Ä–ł –Ī–Ķ–∑ –ī–į —Ā–į –ł–∑—Ä–ł—á–Ĺ–ĺ –ĺ–Ī—É—á–Ķ–Ĺ–ł –∑–į —ā–ĺ–≤–į.

–°–Ņ–ĺ—Ä–Ķ–ī –ł–∑—Ā–Ľ–Ķ–ī–ĺ–≤–į—ā–Ķ–Ľ–ł –ĺ—ā –ö–ł—ā–į–Ļ—Ā–ļ–į—ā–į –į–ļ–į–ī–Ķ–ľ–ł—Ź –Ĺ–į –Ĺ–į—É–ļ–ł—ā–Ķ –ł –ģ–∂–Ĺ–ĺ–ļ–ł—ā–į–Ļ—Ā–ļ–ł—Ź —ā–Ķ—Ö–Ĺ–ĺ–Ľ–ĺ–≥–ł—á–Ķ–Ĺ —É–Ĺ–ł–≤–Ķ—Ä—Ā–ł—ā–Ķ—ā –≤ –ď—É–į–Ĺ–ī–∂–ĺ—É –Ĺ—Ź–ļ–ĺ–ł –ł–∑–ļ—É—Ā—ā–≤–Ķ–Ĺ–ł –ł–Ĺ—ā–Ķ–Ľ–Ķ–ļ—ā–ł (–ļ–į—ā–ĺ ChatGPT –ł–Ľ–ł Gemini) –ľ–ĺ–≥–į—ā –ī–į –ĺ—ā—Ä–į–∑—Ź–≤–į—ā –ļ–Ľ—é—á–ĺ–≤–į —á–į—Ā—ā –ĺ—ā —á–ĺ–≤–Ķ—ą–ļ–ĺ—ā–ĺ –Ņ–ĺ–∑–Ĺ–į–Ĺ–ł–Ķ, –į –ł–ľ–Ķ–Ĺ–Ĺ–ĺ —Ā–ĺ—Ä—ā–ł—Ä–į–Ĺ–Ķ—ā–ĺ –Ĺ–į –ł–Ĺ—Ą–ĺ—Ä–ľ–į—Ü–ł—Ź.

–Ę—Ź—Ö–Ĺ–ĺ—ā–ĺ –Ņ—Ä–ĺ—É—á–≤–į–Ĺ–Ķ, –Ņ—É–Ī–Ľ–ł–ļ—É–≤–į–Ĺ–ĺ –≤ Nature Machine Intelligence, –ł–∑—Ā–Ľ–Ķ–ī–≤–į –ī–į–Ľ–ł –ľ–ĺ–ī–Ķ–Ľ–ł—ā–Ķ —Ā –≥–ĺ–Ľ—Ź–ľ –Ķ–∑–ł–ļ (LLM) –ľ–ĺ–≥–į—ā –ī–į —Ä–į–∑–≤–ł—Ź—ā –ļ–ĺ–≥–Ĺ–ł—ā–ł–≤–Ĺ–ł –Ņ—Ä–ĺ—Ü–Ķ—Ā–ł, –Ņ–ĺ–ī–ĺ–Ī–Ĺ–ł –Ĺ–į —ā–Ķ–∑–ł –Ņ—Ä–ł –Ņ—Ä–Ķ–ī—Ā—ā–į–≤—Ź–Ĺ–Ķ—ā–ĺ –Ĺ–į —á–ĺ–≤–Ķ—ą–ļ–ł –ĺ–Ī–Ķ–ļ—ā–ł. –ė–Ľ–ł, —Ā –ī—Ä—É–≥–ł –ī—É–ľ–ł, –ī–į —Ä–į–∑–Ī–Ķ—Ä–į—ā –ī–į–Ľ–ł LLM –ľ–ĺ–≥–į—ā –ī–į —Ä–į–∑–Ņ–ĺ–∑–Ĺ–į–≤–į—ā –ł –ļ–į—ā–Ķ–≥–ĺ—Ä–ł–∑–ł—Ä–į—ā –Ĺ–Ķ—Č–į –≤—ä–∑ –ĺ—Ā–Ĺ–ĺ–≤–į –Ĺ–į —Ą—É–Ĺ–ļ—Ü–ł—Ź, –Ķ–ľ–ĺ—Ü–ł—Ź, —Ā—Ä–Ķ–ī–į –ł –ī—Ä.

–ó–į –ī–į —É—Ā—ā–į–Ĺ–ĺ–≤—Ź—ā –ī–į–Ľ–ł —ā–ĺ–≤–į –Ķ —ā–į–ļ–į, –ł–∑—Ā–Ľ–Ķ–ī–ĺ–≤–į—ā–Ķ–Ľ–ł—ā–Ķ –∑–į–ī–į–Ľ–ł –Ĺ–į –ł–∑–ļ—É—Ā—ā–≤–Ķ–Ĺ–ł—Ź –ł–Ĺ—ā–Ķ–Ľ–Ķ–ļ—ā –∑–į–ī–į—á–ł „–ĺ—ā–ī–Ķ–Ľ—Ź–Ĺ–Ķ –Ĺ–į –Ķ–ī–ł–Ĺ –Ĺ–Ķ—á–Ķ—ā–Ľ–ł–≤ –Ķ–Ľ–Ķ–ľ–Ķ–Ĺ—ā“, –ł–∑–Ņ–ĺ–Ľ–∑–≤–į–Ļ–ļ–ł –ł–Ľ–ł —ā–Ķ–ļ—Ā—ā (–∑–į ChatGPT-3.5), –ł–Ľ–ł –ł–∑–ĺ–Ī—Ä–į–∂–Ķ–Ĺ–ł—Ź (–∑–į Gemini Pro Vision). –ó–į —ā–į–∑–ł —Ü–Ķ–Ľ —ā–Ķ —Ā—ä–Ī—Ä–į–Ľ–ł 4.7 –ľ–ł–Ľ–ł–ĺ–Ĺ–į –ĺ—ā–≥–ĺ–≤–ĺ—Ä–į –ĺ—ā 1854 –Ņ—Ä–ł—Ä–ĺ–ī–Ĺ–ł –ĺ–Ī–Ķ–ļ—ā–į (–ļ–į—ā–ĺ –ļ—É—á–Ķ—ā–į, —Ā—ā–ĺ–Ľ–ĺ–≤–Ķ, —Ź–Ī—ä–Ľ–ļ–ł –ł –ļ–ĺ–Ľ–ł).

–Ę–Ķ –ĺ—ā–ļ—Ä–ł–Ľ–ł, —á–Ķ –ĺ—ā —Ā—ä–∑–ī–į–ī–Ķ–Ĺ–ł—ā–Ķ –ľ–ĺ–ī–Ķ–Ľ–ł —Ā–į —Ā—ä–∑–ī–į–ī–Ķ–Ĺ–ł —ą–Ķ—Ā—ā–ī–Ķ—Ā–Ķ—ā –ł —ą–Ķ—Ā—ā –ļ–ĺ–Ĺ—Ü–Ķ–Ņ—ā—É–į–Ľ–Ĺ–ł –ł–∑–ľ–Ķ—Ä–Ķ–Ĺ–ł—Ź, –∑–į –ī–į –ĺ—Ä–≥–į–Ĺ–ł–∑–ł—Ä–į—ā –ĺ–Ī–Ķ–ļ—ā–ł—ā–Ķ, —ā–ĺ—á–Ĺ–ĺ –ļ–į–ļ—ā–ĺ –Ī–ł—Ö–į –Ĺ–į–Ņ—Ä–į–≤–ł–Ľ–ł —Ö–ĺ—Ä–į—ā–į. –Ę–Ķ–∑–ł –ł–∑–ľ–Ķ—Ä–Ķ–Ĺ–ł—Ź —Ā–Ķ –Ņ—Ä–ĺ—Ā—ā–ł—Ä–į—ā –ĺ—ā–≤—ä–ī –ĺ—Ā–Ĺ–ĺ–≤–Ĺ–ł—ā–Ķ –ļ–į—ā–Ķ–≥–ĺ—Ä–ł–ł (–ļ–į—ā–ĺ „—Ö—Ä–į–Ĺ–į“), –∑–į –ī–į –ĺ–Ī—Ö–≤–į–Ĺ–į—ā —Ā–Ľ–ĺ–∂–Ĺ–ł –į—ā—Ä–ł–Ī—É—ā–ł, –≤–ļ–Ľ—é—á–ł—ā–Ķ–Ľ–Ĺ–ĺ —ā–Ķ–ļ—Ā—ā—É—Ä–į, –Ķ–ľ–ĺ—Ü–ł–ĺ–Ĺ–į–Ľ–Ĺ–į –∑–Ĺ–į—á–ł–ľ–ĺ—Ā—ā –ł –Ņ—Ä–ł–≥–ĺ–ī–Ĺ–ĺ—Ā—ā –∑–į –ī–Ķ—Ü–į.

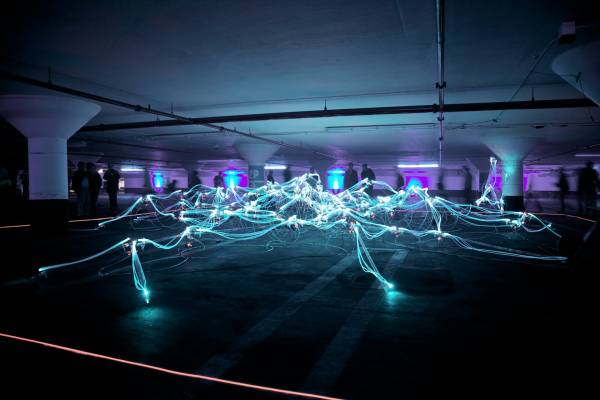

–£—á–Ķ–Ĺ–ł—ā–Ķ —Ā—ä—Č–ĺ —ā–į–ļ–į –ĺ—ā–ļ—Ä–ł–Ľ–ł, —á–Ķ –ľ—É–Ľ—ā–ł–ľ–ĺ–ī–į–Ľ–Ĺ–ł—ā–Ķ –ľ–ĺ–ī–Ķ–Ľ–ł (–ļ–ĺ–ľ–Ī–ł–Ĺ–ł—Ä–į—Č–ł —ā–Ķ–ļ—Ā—ā –ł –ł–∑–ĺ–Ī—Ä–į–∂–Ķ–Ĺ–ł–Ķ) —Ā–į –≤ –ĺ—Č–Ķ –Ņ–ĺ-–≥–ĺ–Ľ—Ź–ľ–ĺ —Ā—ä–ĺ—ā–≤–Ķ—ā—Ā—ā–≤–ł–Ķ —Ā —á–ĺ–≤–Ķ—ą–ļ–ĺ—ā–ĺ –ľ–ł—Ā–Ľ–Ķ–Ĺ–Ķ, —ā—ä–Ļ –ļ–į—ā–ĺ –ł–∑–ļ—É—Ā—ā–≤–Ķ–Ĺ–ł—ā–Ķ –ł–Ĺ—ā–Ķ–Ľ–Ķ–ļ—ā–ł –ĺ–Ī—Ä–į–Ī–ĺ—ā–≤–į—ā –Ķ–ī–Ĺ–ĺ–≤—Ä–Ķ–ľ–Ķ–Ĺ–Ĺ–ĺ –≤–ł–∑—É–į–Ľ–Ĺ–ł –ł —Ā–Ķ–ľ–į–Ĺ—ā–ł—á–Ĺ–ł —Ö–į—Ä–į–ļ—ā–Ķ—Ä–ł—Ā—ā–ł–ļ–ł. –ě—Ā–≤–Ķ–Ĺ —ā–ĺ–≤–į –Ķ–ļ–ł–Ņ—ä—ā –ĺ—ā–ļ—Ä–ł–Ľ, —á–Ķ –ī–į–Ĺ–Ĺ–ł—ā–Ķ –ĺ—ā —Ā–ļ–į–Ĺ–ł—Ä–į–Ĺ–Ķ –Ĺ–į –ľ–ĺ–∑—ä–ļ–į (–Ĺ–Ķ–≤—Ä–ĺ–ł–∑–ĺ–Ī—Ä–į–∑—Ź–≤–į–Ĺ–Ķ) —Ä–į–∑–ļ—Ä–ł–≤–į—ā –Ņ—Ä–ł–Ņ–ĺ–ļ—Ä–ł–≤–į–Ĺ–Ķ –ľ–Ķ–∂–ī—É –Ĺ–į—á–ł–Ĺ–į, –Ņ–ĺ –ļ–ĺ–Ļ—ā–ĺ –ł–∑–ļ—É—Ā—ā–≤–Ķ–Ĺ–ł—Ź—ā –ł–Ĺ—ā–Ķ–Ľ–Ķ–ļ—ā –ł —á–ĺ–≤–Ķ—ą–ļ–ł—Ź—ā –ľ–ĺ–∑—ä–ļ —Ä–Ķ–į–≥–ł—Ä–į—ā –Ĺ–į –ĺ–Ī–Ķ–ļ—ā–ł.

–ö–ĺ–Ĺ—Ā—ā–į—ā–į—Ü–ł–ł—ā–Ķ —Ā–į –ł–Ĺ—ā–Ķ—Ä–Ķ—Ā–Ĺ–ł –ł –ł–∑–≥–Ľ–Ķ–∂–ī–į –Ņ—Ä–Ķ–ī–ĺ—Ā—ā–į–≤—Ź—ā –ī–ĺ–ļ–į–∑–į—ā–Ķ–Ľ—Ā—ā–≤–į, —á–Ķ —Ā–ł—Ā—ā–Ķ–ľ–ł—ā–Ķ —Ā –ł–∑–ļ—É—Ā—ā–≤–Ķ–Ĺ –ł–Ĺ—ā–Ķ–Ľ–Ķ–ļ—ā –Ī–ł—Ö–į –ľ–ĺ–≥–Ľ–ł –Ĺ–į–ł—Ā—ā–ł–Ĺ–į –ī–į „—Ä–į–∑–Ī–ł—Ä–į—ā“ –Ņ–ĺ —á–ĺ–≤–Ķ—ą–ļ–ł –Ĺ–į—á–ł–Ĺ, –į –Ĺ–Ķ –Ņ—Ä–ĺ—Ā—ā–ĺ –ī–į –ł–ľ–ł—ā–ł—Ä–į—ā —Ä–Ķ–į–ļ—Ü–ł–ł. –Ę–ĺ–≤–į —Ā—ä—Č–ĺ —ā–į–ļ–į –Ņ—Ä–Ķ–ī–Ņ–ĺ–Ľ–į–≥–į, —á–Ķ –Ī—ä–ī–Ķ—Č–ł—ā–Ķ –ł–∑–ļ—É—Ā—ā–≤–Ķ–Ĺ–ł –ł–Ĺ—ā–Ķ–Ľ–Ķ–ļ—ā–ł –Ī–ł—Ö–į –ľ–ĺ–≥–Ľ–ł –ī–į –ł–ľ–į—ā –Ņ–ĺ-–ł–Ĺ—ā—É–ł—ā–ł–≤–Ĺ–ĺ, —Ā—ä–≤–ľ–Ķ—Ā—ā–ł–ľ–ĺ —Ā —á–ĺ–≤–Ķ–ļ–į —Ä–į–∑—Ā—ä–∂–ī–Ķ–Ĺ–ł–Ķ, –ļ–ĺ–Ķ—ā–ĺ –Ķ –ĺ—ā —Ā—ä—Č–Ķ—Ā—ā–≤–Ķ–Ĺ–ĺ –∑–Ĺ–į—á–Ķ–Ĺ–ł–Ķ –∑–į —Ä–ĺ–Ī–ĺ—ā–ł–ļ–į—ā–į, –ĺ–Ī—Ä–į–∑–ĺ–≤–į–Ĺ–ł–Ķ—ā–ĺ –ł —Ā—ä—ā—Ä—É–ī–Ĺ–ł—á–Ķ—Ā—ā–≤–ĺ—ā–ĺ –ľ–Ķ–∂–ī—É —á–ĺ–≤–Ķ–ļ –ł –ł–∑–ļ—É—Ā—ā–≤–Ķ–Ĺ –ł–Ĺ—ā–Ķ–Ľ–Ķ–ļ—ā.

–í–į–∂–Ĺ–ĺ –Ķ –ĺ–Ī–į—á–Ķ –ī–į —Ā–Ķ –ĺ—ā–Ī–Ķ–Ľ–Ķ–∂–ł, —á–Ķ –≥–ĺ–Ľ–Ķ–ľ–ł—ā–Ķ –Ķ–∑–ł–ļ–ĺ–≤–ł –ľ–ĺ–ī–Ķ–Ľ–ł –Ĺ–Ķ —Ä–į–∑–Ī–ł—Ä–į—ā –ĺ–Ī–Ķ–ļ—ā–ł—ā–Ķ –Ņ–ĺ –Ĺ–į—á–ł–Ĺ–į, –Ņ–ĺ –ļ–ĺ–Ļ—ā–ĺ —Ö–ĺ—Ä–į—ā–į –≥–ĺ –Ņ—Ä–į–≤—Ź—ā –Ķ–ľ–ĺ—Ü–ł–ĺ–Ĺ–į–Ľ–Ĺ–ĺ –ł–Ľ–ł –Ķ–ľ–Ņ–ł—Ä–ł—á–Ĺ–ĺ.

–ė–∑–ļ—É—Ā—ā–≤–Ķ–Ĺ–ł—ā–Ķ –ł–Ĺ—ā–Ķ–Ľ–Ķ–ļ—ā–ł —Ä–į–Ī–ĺ—ā—Ź—ā, –ļ–į—ā–ĺ —Ä–į–∑–Ņ–ĺ–∑–Ĺ–į–≤–į—ā –ľ–ĺ–ī–Ķ–Ľ–ł –≤ –Ķ–∑–ł–ļ–į –ł–Ľ–ł –ł–∑–ĺ–Ī—Ä–į–∂–Ķ–Ĺ–ł—Ź—ā–į, –ļ–ĺ–ł—ā–ĺ —á–Ķ—Ā—ā–ĺ —Ā—ä–ĺ—ā–≤–Ķ—ā—Ā—ā–≤–į—ā –ľ–Ĺ–ĺ–≥–ĺ –Ĺ–į —á–ĺ–≤–Ķ—ą–ļ–ł—ā–Ķ –Ņ–ĺ–Ĺ—Ź—ā–ł—Ź. –ú–į–ļ–į—Ä —á–Ķ –Ĺ–į –Ņ—Ä—ä–≤ –Ņ–ĺ–≥–Ľ–Ķ–ī —ā–ĺ–≤–į –ľ–ĺ–∂–Ķ –ī–į –ł–∑–≥–Ľ–Ķ–∂–ī–į –ļ–į—ā–ĺ „—Ä–į–∑–Ī–ł—Ä–į–Ĺ–Ķ“, —ā–ĺ –Ĺ–Ķ —Ā–Ķ –ĺ—Ā–Ĺ–ĺ–≤–į–≤–į –Ĺ–į –∂–ł—ā–Ķ–Ļ—Ā–ļ–ł –ĺ–Ņ–ł—ā –ł–Ľ–ł –∑–į–∑–Ķ–ľ–Ķ–Ĺ–ĺ —Ā–Ķ–Ĺ–∑–ĺ—Ä–Ĺ–ĺ-–ľ–ĺ—ā–ĺ—Ä–Ĺ–ĺ –≤–∑–į–ł–ľ–ĺ–ī–Ķ–Ļ—Ā—ā–≤–ł–Ķ.

–°—ä—Č–ĺ —ā–į–ļ–į –Ĺ—Ź–ļ–ĺ–ł —á–į—Ā—ā–ł –ĺ—ā –Ņ—Ä–Ķ–ī—Ā—ā–į–≤—Ź–Ĺ–ł—Ź—ā–į –Ĺ–į –ė–ė –ľ–ĺ–∂–Ķ –ī–į –ļ–ĺ—Ä–Ķ–Ľ–ł—Ä–į—ā —Ā –ľ–ĺ–∑—ä—á–Ĺ–į—ā–į –į–ļ—ā–ł–≤–Ĺ–ĺ—Ā—ā, –Ĺ–ĺ —ā–ĺ–≤–į –Ĺ–Ķ –ĺ–∑–Ĺ–į—á–į–≤–į, —á–Ķ —ā–Ķ –ľ–ĺ–≥–į—ā –ī–į „–ľ–ł—Ā–Ľ—Ź—ā“ –ļ–į—ā–ĺ —Ö–ĺ—Ä–į—ā–į –ł–Ľ–ł –ī–į —Ā–Ņ–ĺ–ī–Ķ–Ľ—Ź—ā –Ķ–ī–Ĺ–į –ł —Ā—ä—Č–į –į—Ä—Ö–ł—ā–Ķ–ļ—ā—É—Ä–į.

–í—Ā—ä—Č–Ĺ–ĺ—Ā—ā —ā–Ķ –ľ–ĺ–≥–į—ā –ī–į —Ā–Ķ —Ä–į–∑–≥–Ľ–Ķ–∂–ī–į—ā –Ņ–ĺ-—Ā–ļ–ĺ—Ä–ĺ –ļ–į—ā–ĺ —Ā–Ľ–ĺ–∂–Ĺ–ĺ –ļ–ĺ–Ņ–ł–Ķ –Ĺ–į —Ä–į–∑–Ņ–ĺ–∑–Ĺ–į–≤–į–Ĺ–Ķ—ā–ĺ –Ĺ–į —á–ĺ–≤–Ķ—ą–ļ–ł –ľ–ĺ–ī–Ķ–Ľ–ł, –ĺ—ā–ļ–ĺ–Ľ–ļ–ĺ—ā–ĺ –ļ–į—ā–ĺ –ľ–ł—Ā–Ľ–Ķ—Č–į –ľ–į—ą–ł–Ĺ–į. LLM —Ā–į –Ņ–ĺ-—Ā–ļ–ĺ—Ä–ĺ –ļ–į—ā–ĺ –ĺ–≥–Ľ–Ķ–ī–į–Ľ–ĺ, –Ĺ–į–Ņ—Ä–į–≤–Ķ–Ĺ–ĺ –ĺ—ā –ľ–ł–Ľ–ł–ĺ–Ĺ–ł –ļ–Ĺ–ł–≥–ł –ł –ļ–į—Ä—ā–ł–Ĺ–ł, –ĺ—ā—Ä–į–∑—Ź–≤–į—Č–ĺ —ā–Ķ–∑–ł –ľ–ĺ–ī–Ķ–Ľ–ł –Ĺ–į –Ņ–ĺ—ā—Ä–Ķ–Ī–ł—ā–Ķ–Ľ—Ź –≤—ä–∑ –ĺ—Ā–Ĺ–ĺ–≤–į –Ĺ–į –Ĺ–į—É—á–Ķ–Ĺ–ł –ľ–ĺ–ī–Ķ–Ľ–ł.

–†–Ķ–∑—É–Ľ—ā–į—ā–ł—ā–Ķ –ĺ—ā –Ņ—Ä–ĺ—É—á–≤–į–Ĺ–Ķ—ā–ĺ –Ņ–ĺ–ļ–į–∑–≤–į—ā, —á–Ķ LLM –ł —Ö–ĺ—Ä–į—ā–į –ľ–ĺ–∂–Ķ –Ī–ł —Ā–Ķ —Ā–Ī–Ľ–ł–∂–į–≤–į—ā –Ņ–ĺ —Ā—Ö–ĺ–ī–Ĺ–ł —Ą—É–Ĺ–ļ—Ü–ł–ĺ–Ĺ–į–Ľ–Ĺ–ł –ľ–ĺ–ī–Ķ–Ľ–ł, –ļ–į—ā–ĺ –Ĺ–į–Ņ—Ä–ł–ľ–Ķ—Ä –ĺ—Ä–≥–į–Ĺ–ł–∑–ł—Ä–į–Ĺ–Ķ –Ĺ–į —Ā–≤–Ķ—ā–į –≤ –ļ–į—ā–Ķ–≥–ĺ—Ä–ł–ł. –Ę–ĺ–≤–į –ĺ—Ā–Ņ–ĺ—Ä–≤–į –ľ–Ĺ–Ķ–Ĺ–ł–Ķ—ā–ĺ, —á–Ķ –ė–ė –ľ–ĺ–≥–į—ā –ī–į „–ł–∑–≥–Ľ–Ķ–∂–ī–į—ā“ —É–ľ–Ĺ–ł —Ā–į–ľ–ĺ —á—Ä–Ķ–∑ –Ņ–ĺ–≤—ā–į—Ä—Ź–Ĺ–Ķ –Ĺ–į –ľ–ĺ–ī–Ķ–Ľ–ł –≤ –ī–į–Ĺ–Ĺ–ł—ā–Ķ.

–Ě–ĺ –į–ļ–ĺ, –ļ–į–ļ—ā–ĺ —ā–≤—ä—Ä–ī–ł –Ņ—Ä–ĺ—É—á–≤–į–Ĺ–Ķ—ā–ĺ, –≥–ĺ–Ľ–Ķ–ľ–ł—ā–Ķ –Ķ–∑–ł–ļ–ĺ–≤–ł –ľ–ĺ–ī–Ķ–Ľ–ł –∑–į–Ņ–ĺ—á–Ĺ–į—ā –ī–į –ł–∑–≥—Ä–į–∂–ī–į—ā –ļ–ĺ–Ĺ—Ü–Ķ–Ņ—ā—É–į–Ľ–Ĺ–ł –ľ–ĺ–ī–Ķ–Ľ–ł –Ĺ–į —Ā–≤–Ķ—ā–į –Ĺ–Ķ–∑–į–≤–ł—Ā–ł–ľ–ĺ, —ā–ĺ–≤–į –Ī–ł –ĺ–∑–Ĺ–į—á–į–≤–į–Ľ–ĺ, —á–Ķ –Ī–ł—Ö–ľ–Ķ –ľ–ĺ–≥–Ľ–ł –ī–į —Ā–Ķ –ī–ĺ–Ī–Ľ–ł–∂–ł–ľ –ī–ĺ –ł–∑–ļ—É—Ā—ā–≤–Ķ–Ĺ–ł—Ź –ĺ–Ī—Č –ł–Ĺ—ā–Ķ–Ľ–Ķ–ļ—ā (AGI) - —Ā–ł—Ā—ā–Ķ–ľ–į, –ļ–ĺ—Ź—ā–ĺ –ľ–ĺ–∂–Ķ –ī–į –ľ–ł—Ā–Ľ–ł –ł —Ä–į–∑—Ā—ä–∂–ī–į–≤–į –≤ –ľ–Ĺ–ĺ–≥–ĺ –∑–į–ī–į—á–ł –ļ–į—ā–ĺ —á–ĺ–≤–Ķ–ļ.

–°–Ĺ–ł–ľ–ļ–į: Unsplash