ИИ асистентите са изненадващо умели в измислянето на информация и представянето ѝ като факт. Фалшиви твърдения, измислени източници и фабрикувани цитати са част от проблемите при работа с данни. Тези грешки обикновено се наричат халюцинации. Много потребители вероятно са свикнали с проблема и често разчитат на собствената си проверка на фактите, за да разграничат истината от измислицата. Но според OpenAI може да има алтернатива. Сега компанията, стояща зад ChatGPT, публикува подробен доклад, който предлага ново обяснение защо се случват халюцинациите – и потенциално решение.

36-страничната статия, написана от двойка учени от Georgia Tech и други изследователи от OpenAI, изяснява едно нещо: халюцинациите не се дължат на небрежно писане, а на начина, по който са настроени настоящите показатели за оценка. Тези показатели са склонни да награждават уверените предположения и да наказват изразите на несигурност. Изследователите сравняват това с тестовете с множествен избор – тези, които познават, получават точки, а тези, които оставят въпросите празни, не получават нищо. Статистически погледнато, моделът на познаване излиза начело, дори и да предоставя често невярна информация.

В резултат на това днешните класации, които оценяват представянето на ИИ, се фокусират почти изцяло върху точността, пренебрегвайки както процента на грешки, така и несигурността. OpenAI призовава за промяна. Вместо просто да отчитат верните отговори, класациите трябва да наказват по-строго уверените грешки, като в същото време дават известна оценка за предпазливото въздържане. Целта е да се насърчат моделите да признават несигурността, вместо уверено да представят невярна информация като факт.

Един пример от статията показва разликата, която този подход може да направи. В теста SimpleQA един модел избра да не отговаря на повече от половината въпроси, но се оказа грешен само в 26% от отговорите, които даде. Друг модел отговори на почти всеки въпрос, но в около 75% от случаите даде неверни отговори. Изводът е ясен: проявяването на несигурност е по-надеждно от увереното предположение, което създава само илюзия за точност.

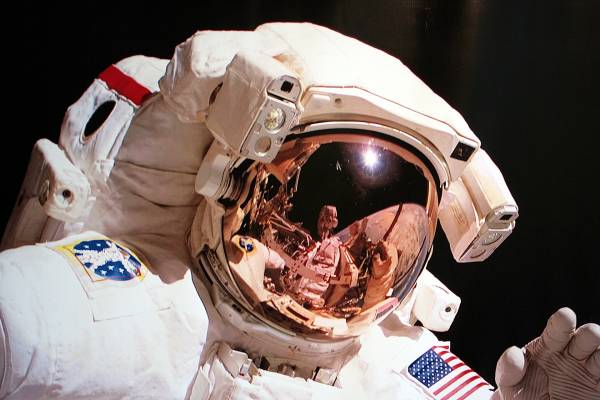

Снимка: Unsplash

Виж още: Краят на една епоха: пощата в Дания спира да доставя писма, защото светът е дигитален (ВИДЕО)