–Ґ–∞–Ј–Є —Б–µ–і–Љ–Є—Ж–∞ OpenAI –Њ–±—П–≤–Є Sora - —З–Є—Б—В–Њ –љ–Њ–≤ –Љ–Њ–і–µ–ї, –Ї–Њ–є—В–Њ –≥–µ–љ–µ—А–Є—А–∞ –≤–Є–і–µ–Њ–Ї–ї–Є–њ–Њ–≤–µ —Б –≤–Є—Б–Њ–Ї–∞ —А–∞–Ј–і–µ–ї–Є—В–µ–ї–љ–∞ —Б–њ–Њ—Б–Њ–±–љ–Њ—Б—В —Б –і—К–ї–ґ–Є–љ–∞ –і–Њ –µ–і–љ–∞ –Љ–Є–љ—Г—В–∞ –Њ—В —В–µ–Ї—Б—В–Њ–≤–Є –њ–Њ–і—Б–Ї–∞–Ј–Ї–Є. Sora, –Ї–Њ–µ—В–Њ –љ–∞ —П–њ–Њ–љ—Б–Ї–Є –Њ–Ј–љ–∞—З–∞–≤–∞ "–љ–µ–±–µ", —Б–Ї–Њ—А–Њ –љ—П–Љ–∞ –і–∞ –±—К–і–µ –і–Њ—Б—В—К–њ–µ–љ –Ј–∞ —И–Є—А–Њ–Ї–∞—В–∞ –њ—Г–±–ї–Є–Ї–∞. –Т–Љ–µ—Б—В–Њ —В–Њ–≤–∞ OpenAI –≥–Њ –њ—А–µ–і–Њ—Б—В–∞–≤—П –љ–∞ –Љ–∞–ї–Ї–∞ –≥—А—Г–њ–∞ —Г—З–µ–љ–Є –Є –Є–Ј—Б–ї–µ–і–Њ–≤–∞—В–µ–ї–Є, –Ї–Њ–Є—В–Њ —Й–µ –Њ—Ж–µ–љ—П—В –≤—А–µ–і–∞—В–∞ –Є –њ–Њ—В–µ–љ—Ж–Є–∞–ї–∞ –Љ—Г –Ј–∞ –Ј–ї–Њ—Г–њ–Њ—В—А–µ–±–∞.

"Sora –µ –≤ —Б—К—Б—В–Њ—П–љ–Є–µ –і–∞ –≥–µ–љ–µ—А–Є—А–∞ —Б–ї–Њ–ґ–љ–Є —Б—Ж–µ–љ–Є —Б –Љ–љ–Њ–ґ–µ—Б—В–≤–Њ –≥–µ—А–Њ–Є, —Б–њ–µ—Ж–Є—Д–Є—З–љ–Є –≤–Є–і–Њ–≤–µ –і–≤–Є–ґ–µ–љ–Є–µ –Є —В–Њ—З–љ–Є –і–µ—В–∞–є–ї–Є –љ–∞ –Њ–±–µ–Ї—В–∞ –Є —Д–Њ–љ–∞", –Ј–∞—П–≤–Є –Ї–Њ–Љ–њ–∞–љ–Є—П—В–∞ –љ–∞ —Б–≤–Њ—П —Г–µ–±—Б–∞–є—В. "–Ь–Њ–і–µ–ї—К—В —А–∞–Ј–±–Є—А–∞ –љ–µ —Б–∞–Љ–Њ –Ї–∞–Ї–≤–Њ –µ –њ–Њ–Є—Б–Ї–∞–ї –њ–Њ—В—А–µ–±–Є—В–µ–ї—П—В –≤ –њ–Њ–і–Ї–∞–љ–∞, –љ–Њ –Є –Ї–∞–Ї —В–µ–Ј–Є –љ–µ—Й–∞ —Б—К—Й–µ—Б—В–≤—Г–≤–∞—В –≤—К–≤ —Д–Є–Ј–Є—З–µ—Б–Ї–Є—П —Б–≤—П—В."

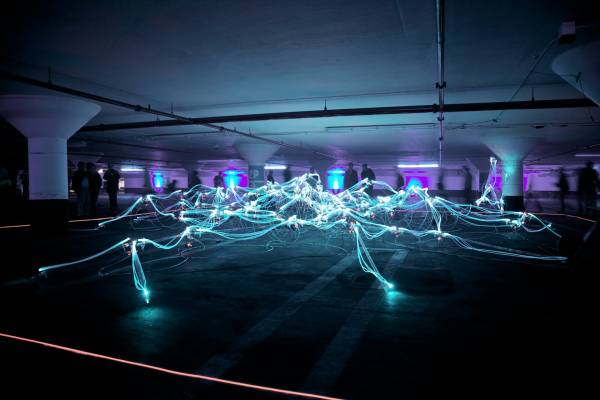

–Х–і–Є–љ –Њ—В –≤–Є–і–µ–Њ–Ї–ї–Є–њ–Њ–≤–µ—В–µ, –≥–µ–љ–µ—А–Є—А–∞–љ–Є –Њ—В Sora, –Ї–Њ–Є—В–Њ OpenAI —Б–њ–Њ–і–µ–ї–Є –љ–∞ —Г–µ–±—Б–∞–є—В–∞ —Б–Є, –њ–Њ–Ї–∞–Ј–≤–∞ –і–≤–Њ–є–Ї–∞, –Ї–Њ—П—В–Њ —Б–µ —А–∞–Ј—Е–Њ–ґ–і–∞ –Є–Ј –Ј–∞—Б–љ–µ–ґ–µ–љ –≥—А–∞–і –Ґ–Њ–Ї–Є–Њ, –і–Њ–Ї–∞—В–Њ –Њ–Ї–Њ–ї–Њ —В—П—Е —Б–µ —А–µ—П—В –ї–Є—Б—В–µ–љ—Ж–∞ –Њ—В —З–µ—А–µ—И–Њ–≤–Є —Ж–≤–µ—В–Њ–≤–µ –Є —Б–љ–µ–ґ–Є–љ–Ї–Є.

–Ю—В OpenAI —В–≤—К—А–і—П—В, —З–µ –Љ–Њ–і–µ–ї—К—В —А–∞–±–Њ—В–Є –≤ —А–µ–Ј—Г–ї—В–∞—В –љ–∞ "–і—К–ї–±–Њ–Ї–Њ —А–∞–Ј–±–Є—А–∞–љ–µ –љ–∞ –µ–Ј–Є–Ї–∞", –Ї–Њ–µ—В–Њ –Љ—Г –њ–Њ–Ј–≤–Њ–ї—П–≤–∞ –і–∞ –Є–љ—В–µ—А–њ—А–µ—В–Є—А–∞ —В–Њ—З–љ–Њ —В–µ–Ї—Б—В–Њ–≤–Є—В–µ –њ–Њ–і–Ї–∞–љ–Є. –Т—К–њ—А–µ–Ї–Є —В–Њ–≤–∞, –Ї–∞–Ї—В–Њ –≤—Б–Є—З–Ї–Є –≥–µ–љ–µ—А–∞—В–Њ—А–Є –љ–∞ –Є–Ј–Њ–±—А–∞–ґ–µ–љ–Є—П –Є –≤–Є–і–µ–Њ–Ї–ї–Є–њ–Њ–≤–µ —Б –Є–Ј–Ї—Г—Б—В–≤–µ–љ –Є–љ—В–µ–ї–µ–Ї—В, –Ї–Њ–Є—В–Њ —Б–Љ–µ –≤–Є–ґ–і–∞–ї–Є, Sora –љ–µ –µ —Б—К–≤—К—А—И–µ–љ–∞ —В–µ—Е–љ–Њ–ї–Њ–≥–Є—П. –Т –µ–і–Є–љ –Њ—В –њ—А–Є–Љ–µ—А–Є—В–µ –њ–Њ–і–Ї–∞–љ–≤–∞–љ–µ—В–Њ, –Ї–Њ–µ—В–Њ –Є–Ј–Є—Б–Ї–≤–∞ –≤–Є–і–µ–Њ–Ї–ї–Є–њ —Б –і–∞–ї–Љ–∞—В–Є–љ–µ—Ж, –≥–ї–µ–і–∞—Й –њ—А–µ–Ј –њ—А–Њ–Ј–Њ—А–µ—Ж–∞, –Є —Е–Њ—А–∞, –Ї–Њ–Є—В–Њ "—Б–µ —А–∞–Ј—Е–Њ–ґ–і–∞—В –Є –Ї–∞—А–∞—В –Ї–Њ–ї–µ–ї–Њ –њ–Њ —Г–ї–Є—Ж–Є—В–µ –љ–∞ –Ї–∞–љ–∞–ї–∞", –њ—А–Њ–њ—Г—Б–Ї–∞ –Є–Ј—Ж—П–ї–Њ —Е–Њ—А–∞—В–∞ –Є —Г–ї–Є—Ж–Є—В–µ –≤—К–≤ –≤–Є–і–µ–Њ–Ї–ї–Є–њ–∞. OpenAI —Б—К—Й–Њ —В–∞–Ї–∞ –њ—А–µ–і—Г–њ—А–µ–ґ–і–∞–≤–∞, —З–µ –Љ–Њ–і–µ–ї—К—В –Љ–Њ–ґ–µ –і–∞ –Є–Љ–∞ –њ—А–Њ–±–ї–µ–Љ–Є —Б —А–∞–Ј–±–Є—А–∞–љ–µ—В–Њ –љ–∞ –њ—А–Є—З–Є–љ–Є—В–µ –Є —Б–ї–µ–і—Б—В–≤–Є—П—В–∞ - —В–Њ–є –Љ–Њ–ґ–µ –і–∞ –≥–µ–љ–µ—А–Є—А–∞ –≤–Є–і–µ–Њ–Ї–ї–Є–њ –љ–∞ —З–Њ–≤–µ–Ї, –Ї–Њ–є—В–Њ —П–і–µ –±–Є—Б–Ї–≤–Є—В–Ї–∞ –љ–∞–њ—А–Є–Љ–µ—А, –љ–Њ –±–Є—Б–Ї–≤–Є—В–Ї–∞—В–∞ –Љ–Њ–ґ–µ –і–∞ –љ—П–Љ–∞ —Б–ї–µ–і–Є –Њ—В –Ј–∞—Е–∞–њ–≤–∞–љ–µ.

Sora –љ–µ –µ –њ—К—А–≤–Є—П—В –Љ–Њ–і–µ–ї –Ј–∞ –њ—А–µ–Њ–±—А–∞–Ј—Г–≤–∞–љ–µ –љ–∞ —В–µ–Ї—Б—В –≤—К–≤ –≤–Є–і–µ–Њ. –Ф—А—Г–≥–Є –Ї–Њ–Љ–њ–∞–љ–Є–Є, —Б—А–µ–і –Ї–Њ–Є—В–Њ Meta, Google –Є Runway, –Є–ї–Є —Б–∞ —Б–µ –њ–Њ–і–Є–≥—А–∞–≤–∞–ї–Є —Б –Є–љ—Б—В—А—Г–Љ–µ–љ—В–Є—В–µ –Ј–∞ –њ—А–µ–Њ–±—А–∞–Ј—Г–≤–∞–љ–µ –љ–∞ —В–µ–Ї—Б—В –≤—К–≤ –≤–Є–і–µ–Њ, –Є–ї–Є —Б–∞ –≥–Є –љ–∞–њ—А–∞–≤–Є–ї–Є –і–Њ—Б—В—К–њ–љ–Є –Ј–∞ –Њ–±—Й–µ—Б—В–≤–µ–љ–Њ—Б—В—В–∞. –Т—Б–µ –њ–∞–Ї –Ї—К–Љ –Љ–Њ–Љ–µ–љ—В–∞ –љ–Є–Ї–Њ–є –і—А—Г–≥ –Є–љ—Б—В—А—Г–Љ–µ–љ—В –љ–µ –µ –≤ —Б—К—Б—В–Њ—П–љ–Є–µ –і–∞ –≥–µ–љ–µ—А–Є—А–∞ –≤–Є–і–µ–Њ–Ї–ї–Є–њ–Њ–≤–µ —Б –і—К–ї–ґ–Є–љ–∞ 60 —Б–µ–Ї—Г–љ–і–Є. Sora —Б—К—Й–Њ —В–∞–Ї–∞ –≥–µ–љ–µ—А–Є—А–∞ —Ж–µ–ї–Є –≤–Є–і–µ–Њ–Ї–ї–Є–њ–Њ–≤–µ –љ–∞–≤–µ–і–љ—К–ґ, –≤–Љ–µ—Б—В–Њ –і–∞ –≥–Є —Б–≥–ї–Њ–±—П–≤–∞ –Ї–∞–і—К—А –њ–Њ –Ї–∞–і—К—А, –Ї–∞–Ї—В–Њ –і—А—Г–≥–Є—В–µ –Љ–Њ–і–µ–ї–Є, –Ї–Њ–µ—В–Њ –≥–∞—А–∞–љ—В–Є—А–∞, —З–µ —Б—Г–±–µ–Ї—В–Є—В–µ –≤—К–≤ –≤–Є–і–µ–Њ–Ї–ї–Є–њ–∞ –Њ—Б—В–∞–≤–∞—В —Б—К—Й–Є—В–µ, –і–Њ—А–Є –Ї–Њ–≥–∞—В–Њ –≤—А–µ–Љ–µ–љ–љ–Њ –љ–µ —Б–µ –≤–Є–ґ–і–∞—В.

–Т—К–Ј—Е–Њ–і—К—В –љ–∞ –Є–љ—Б—В—А—Г–Љ–µ–љ—В–Є—В–µ –Ј–∞ –њ—А–µ–Њ–±—А–∞–Ј—Г–≤–∞–љ–µ –љ–∞ —В–µ–Ї—Б—В –≤—К–≤ –≤–Є–і–µ–Њ –њ—А–µ–і–Є–Ј–≤–Є–Ї–∞ –Њ–њ–∞—Б–µ–љ–Є—П –Њ—В–љ–Њ—Б–љ–Њ –њ–Њ—В–µ–љ—Ж–Є–∞–ї–∞ –Є–Љ –Ј–∞ –њ–Њ-–ї–µ—Б–љ–Њ —Б—К–Ј–і–∞–≤–∞–љ–µ –љ–∞ —А–µ–∞–ї–Є—Б—В–Є—З–љ–Њ –Є–Ј–≥–ї–µ–ґ–і–∞—Й–Є —Д–∞–ї—И–Є–≤–Є –Ї–∞–і—А–Є.

"–Р–±—Б–Њ–ї—О—В–љ–Њ —Б–µ —Г–ґ–∞—Б—П–≤–∞–Љ, —З–µ –њ–Њ–і–Њ–±–љ–Є –љ–µ—Й–∞ —Й–µ –њ–Њ–≤–ї–Є—П—П—В –љ–∞ –Є–Ј–±–Њ—А–Є—В–µ, –Ї–Њ–Є—В–Њ —Б–µ –њ—А–Њ–≤–µ–ґ–і–∞—В –љ–∞ –Ї–Њ—Б—К–Љ –Њ—В –њ–Њ–±–µ–і–∞—В–∞", –Ї–∞–Ј–≤–∞ –њ—А–µ–і The New York Times –Ю—А–µ–љ –Х—В—Ж–Є–Њ–љ–Є, –њ—А–Њ—Д–µ—Б–Њ—А –≤—К–≤ –Т–∞—И–Є–љ–≥—В–Њ–љ—Б–Ї–Є—П —Г–љ–Є–≤–µ—А—Б–Є—В–µ—В, –Ї–Њ–є—В–Њ —Б–њ–µ—Ж–Є–∞–ї–Є–Ј–Є—А–∞ –≤ –Њ–±–ї–∞—Б—В—В–∞ –љ–∞ –Є–Ј–Ї—Г—Б—В–≤–µ–љ–Є—П –Є–љ—В–µ–ї–µ–Ї—В, –Є –Њ—Б–љ–Њ–≤–∞—В–µ–ї –љ–∞ True Media, –Њ—А–≥–∞–љ–Є–Ј–∞—Ж–Є—П, –Ї–Њ—П—В–Њ —А–∞–±–Њ—В–Є –Ј–∞ –Є–і–µ–љ—В–Є—Д–Є—Ж–Є—А–∞–љ–µ –љ–∞ –і–µ–Ј–Є–љ—Д–Њ—А–Љ–∞—Ж–Є—П—В–∞ –≤ –њ–Њ–ї–Є—В–Є—З–µ—Б–Ї–Є—В–µ –Ї–∞–Љ–њ–∞–љ–Є–Є. –Ш –≤ –њ–Њ-—И–Є—А–Њ–Ї –њ–ї–∞–љ –≥–µ–љ–µ—А–∞—В–Є–≤–љ–Є—П—В –Є–Ј–Ї—Г—Б—В–≤–µ–љ –Є–љ—В–µ–ї–µ–Ї—В –њ—А–µ–і–Є–Ј–≤–Є–Ї–∞ –Њ—В–њ–Њ—А –Њ—В —Б—В—А–∞–љ–∞ –љ–∞ –∞—А—В–Є—Б—В–Є –Є —В–≤–Њ—А—З–µ—Б–Ї–Є —Б–њ–µ—Ж–Є–∞–ї–Є—Б—В–Є, –Ј–∞–≥—А–Є–ґ–µ–љ–Є, —З–µ —В–µ—Е–љ–Њ–ї–Њ–≥–Є—П—В–∞ —Б–µ –Є–Ј–њ–Њ–ї–Ј–≤–∞ –Ј–∞ –Ј–∞–Љ–µ—Б—В–≤–∞–љ–µ –љ–∞ —А–∞–±–Њ—В–љ–Є –Љ–µ—Б—В–∞.

–°–љ–Є–Љ–Ї–∞: OpenAI