–Ю—В–і–∞–≤–љ–∞ —В–ї–µ–µ—Й–∞—В–∞ –Ї—А–Є–Ј–∞ –љ–∞ –Є–і–µ–љ—В–Є—З–љ–Њ—Б—В—В–∞ –≤ –Њ–±—Й–љ–Њ—Б—В—В–∞ –љ–∞ –Њ—В–≤–Њ—А–µ–љ–Є—П –Ї–Њ–і –њ–Њ –Њ—В–љ–Њ—И–µ–љ–Є–µ –љ–∞ –Є–Ј–Ї—Г—Б—В–≤–µ–љ–Є—П –Є–љ—В–µ–ї–µ–Ї—В —В–Њ–Ї—Г-—Й–Њ –њ–Њ–ї—Г—З–Є —В–∞–Ї–∞ –љ–µ–Њ–±—Е–Њ–і–Є–Љ–∞—В–∞ –і–Њ–Ј–∞ –њ—А–∞–≥–Љ–∞—В–Є–Ј—К–Љ. –Ґ–∞–Ј–Є —Б–µ–і–Љ–Є—Ж–∞ –њ—А–Њ–µ–Ї—В—К—В –Ј–∞ —П–і—А–Њ—В–Њ –љ–∞ Linux –љ–∞–є-–љ–∞–Ї—А–∞—П –≤—К–≤–µ–і–µ –Њ—Д–Є—Ж–Є–∞–ї–љ–∞ –њ–Њ–ї–Є—В–Є–Ї–∞, –≤–∞–ї–Є–і–љ–∞ –Ј–∞ —Ж–µ–ї–Є—П –њ—А–Њ–µ–Ї—В, –Ї–Њ—П—В–Њ –Є–Ј—А–Є—З–љ–Њ —А–∞–Ј—А–µ—И–∞–≤–∞ –њ—А–Є–љ–Њ—Б–∞ –љ–∞ –Ї–Њ–і, —Б—К–Ј–і–∞–і–µ–љ —Б –њ–Њ–Љ–Њ—Й—В–∞ –љ–∞ –Ш–Ш, –њ—А–Є —Г—Б–ї–Њ–≤–Є–µ —З–µ —А–∞–Ј—А–∞–±–Њ—В—З–Є—Ж–Є—В–µ —Б–њ–∞–Ј–≤–∞—В —Б—В—А–Њ–≥–Є –љ–Њ–≤–Є –њ—А–∞–≤–Є–ї–∞ –Ј–∞ —А–∞–Ј–Ї—А–Є–≤–∞–љ–µ –љ–∞ –Є–љ—Д–Њ—А–Љ–∞—Ж–Є—П.

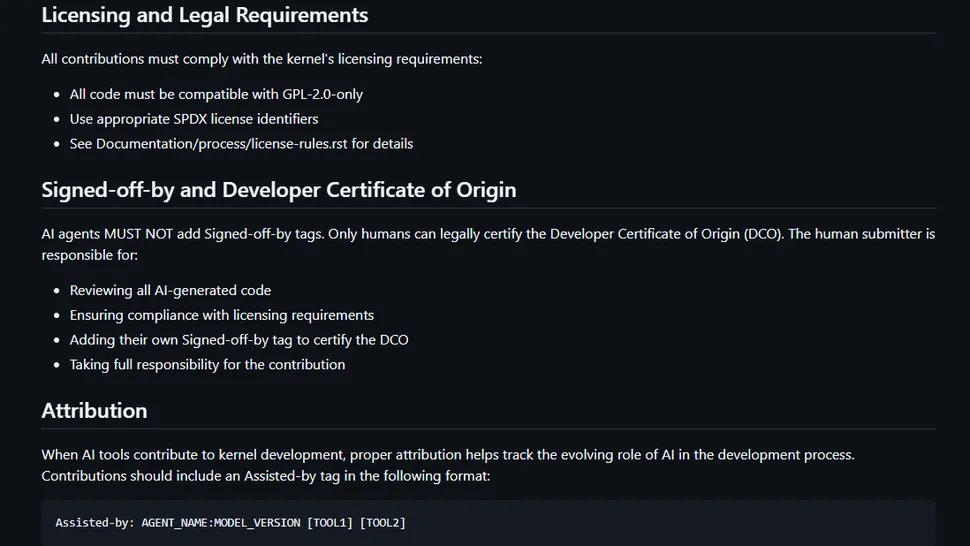

–Э–Њ–≤–Є—В–µ –љ–∞—Б–Њ–Ї–Є –њ–Њ—Б—В–∞–љ–Њ–≤—П–≤–∞—В, —З–µ –Ш–Ш –∞–≥–µ–љ—В–Є—В–µ –љ–µ –Љ–Њ–≥–∞—В –і–∞ –Є–Ј–њ–Њ–ї–Ј–≤–∞—В –њ—А–∞–≤–љ–Њ –Њ–±–≤—К—А–Ј–≤–∞—Й–Є—П —В–∞–≥ Signed-off-by, –∞ –≤–Љ–µ—Б—В–Њ —В–Њ–≤–∞ –Є–Ј–Є—Б–Ї–≤–∞—В –љ–Њ–≤ —В–∞–≥ Assisted-by —Б —Ж–µ–ї –њ—А–Њ–Ј—А–∞—З–љ–Њ—Б—В. –Т –Ї—А–∞–є–љ–∞ —Б–Љ–µ—В–Ї–∞ –њ–Њ–ї–Є—В–Є–Ї–∞—В–∞ —О—А–Є–і–Є—З–µ—Б–Ї–Є –Ј–∞–Ї—А–µ–њ–≤–∞ –≤—Б—П–Ї–∞ –µ–і–љ–∞ –ї–Є–љ–Є—П –Ї–Њ–і, –≥–µ–љ–µ—А–Є—А–∞–љ–∞ –Њ—В –Ш–Ш, –Ї–∞–Ї—В–Њ –Є –≤—Б–Є—З–Ї–Є –њ—А–Њ–Є–Ј—В–Є—З–∞—Й–Є –Њ—В —В–Њ–≤–∞ –±—К–≥–Њ–≤–µ –Є–ї–Є –њ—А–Њ–њ—Г—Б–Ї–Є –≤ —Б–Є–≥—Г—А–љ–Њ—Б—В—В–∞, —В–≤—К—А–і–Њ –≤—К—А—Е—Г —А–∞–Љ–µ–љ–µ—В–µ –љ–∞ —З–Њ–≤–µ–Ї–∞, –Ї–Њ–є—В–Њ —П –њ–Њ–і–∞–≤–∞.

–Ґ–∞–Ј–Є —Б—В—К–њ–Ї–∞ –Є–і–≤–∞ —Б–ї–µ–і –љ—П–Ї–Њ–ї–Ї–Њ —Е–∞–Њ—В–Є—З–љ–Є –Љ–µ—Б–µ—Ж–∞ –≤ —Б–≤–µ—В–∞ –љ–∞ –Њ—В–≤–Њ—А–µ–љ–Є—П –Ї–Њ–і –Є —Б–ї–∞–≥–∞ –Ї—А–∞–є –љ–∞ –Њ–ґ–µ—Б—В–Њ—З–µ–љ–∞ –і–Є—Б–Ї—Г—Б–Є—П, –Ї–Њ—П—В–Њ –і–Њ—Б—В–Є–≥–љ–∞ —Б–≤–Њ—П –њ–Є–Ї –њ—А–µ–Ј —П–љ—Г–∞—А–Є, –Ї–Њ–≥–∞—В–Њ –Ф–µ–є–≤ –•–∞–љ—Б–µ–љ –Њ—В Intel –Є –Ы–Њ—А–µ–љ—Ж–Њ –°—В–Њ—Г–Ї—Б –Њ—В Oracle —Б–µ —Б–±–ї—К—Б–Ї–∞—Е–∞ –њ–Њ –≤—К–њ—А–Њ—Б–∞ –Ї–Њ–ї–Ї–Њ —Б—В—А–Њ–≥–Њ —П–і—А–Њ—В–Њ —В—А—П–±–≤–∞ –і–∞ –Ї–Њ–љ—В—А–Њ–ї–Є—А–∞ –Є–љ—Б—В—А—Г–Љ–µ–љ—В–Є—В–µ –Ј–∞ –Є–Ј–Ї—Г—Б—В–≤–µ–љ –Є–љ—В–µ–ї–µ–Ї—В. –°—К–Ј–і–∞—В–µ–ї—П—В –љ–∞ –њ–ї–∞—В—Д–Њ—А–Љ–∞—В–∞ –Ы–Є–љ—Г—Б –Ґ–Њ—А–≤–∞–ї–і—Б, –≤ —В–Є–њ–Є—З–љ–Є—П —Б–Є –њ—А—П–Љ —Б—В–Є–ї, –≤ –Ї—А–∞–є–љ–∞ —Б–Љ–µ—В–Ї–∞ —Б–ї–Њ–ґ–Є –Ї—А–∞–є –љ–∞ —Б–њ–Њ—А–∞, –Ї–∞—В–Њ –љ–∞—А–µ—З–µ –і–µ–±–∞—В–∞ –Ј–∞ –њ—К–ї–љ–∞—В–∞ –Ј–∞–±—А–∞–љ–∞ „–±–µ–Ј—Б–Љ–Є—Б–ї–µ–љ–Њ –Ј–∞–µ–Љ–∞–љ–µ –љ–∞ —Б—В—А–∞–љ–Є“.

–Я–Њ–Ј–Є—Ж–Є—П—В–∞ –љ–∞ –Ґ–Њ—А–≤–∞–ї–і—Б, –Ї–Њ—П—В–Њ —Д–Њ—А–Љ–Є—А–∞ —Д–Є–ї–Њ—Б–Њ—Д—Б–Ї–∞—В–∞ –Њ—Б–љ–Њ–≤–∞ –љ–∞ —В–∞–Ј–Є –љ–Њ–≤–∞ –њ–Њ–ї–Є—В–Є–Ї–∞, –µ –Є–Ј–Ї–ї—О—З–Є—В–µ–ї–љ–Њ —П—Б–љ–∞: –Є–Ј–Ї—Г—Б—В–≤–µ–љ–Є—П—В –Є–љ—В–µ–ї–µ–Ї—В –µ –њ—А–Њ—Б—В–Њ –Њ—Й–µ –µ–і–Є–љ –Є–љ—Б—В—А—Г–Љ–µ–љ—В. –Ч–ї–Њ–љ–∞–Љ–µ—А–µ–љ–Є—В–µ –ї–Є—Ж–∞, –Ї–Њ–Є—В–Њ –њ–Њ–і–∞–≤–∞—В –±–Њ–Ї–ї—Г—З–∞–≤ –Ї–Њ–і, —В–∞–Ї–∞ –Є–ї–Є –Є–љ–∞—З–µ –љ—П–Љ–∞ –і–∞ –њ—А–Њ—З–µ—В–∞—В –і–Њ–Ї—Г–Љ–µ–љ—В–∞—Ж–Є—П—В–∞, —В–∞–Ї–∞ —З–µ —П–і—А–Њ—В–Њ —В—А—П–±–≤–∞ –і–∞ —Б–µ —Д–Њ–Ї—Г—Б–Є—А–∞ –≤—К—А—Е—Г —В–Њ–≤–∞ –і–∞ –і—К—А–ґ–Є —З–Њ–≤–µ—И–Ї–Є—В–µ —А–∞–Ј—А–∞–±–Њ—В—З–Є—Ж–Є –Њ—В–≥–Њ–≤–Њ—А–љ–Є, –≤–Љ–µ—Б—В–Њ –і–∞ —Б–µ –Њ–њ–Є—В–≤–∞ –і–∞ –Ї–Њ–љ—В—А–Њ–ї–Є—А–∞ —Б–Њ—Д—В—Г–µ—А–∞, –Ї–Њ–є—В–Њ —В–µ –Є–Ј–њ—К–ї–љ—П–≤–∞—В –љ–∞ —Б–≤–Њ–Є—В–µ –ї–Њ–Ї–∞–ї–љ–Є –Љ–∞—И–Є–љ–Є. –Ґ–Њ–≤–∞ –µ –Є–Ј–Ї–ї—О—З–Є—В–µ–ї–љ–Њ —А–∞–Ј—Г–Љ–µ–љ –Є –њ—А–∞–≥–Љ–∞—В–Є—З–µ–љ –њ–Њ–і—Е–Њ–і, –Њ—Б–Њ–±–µ–љ–Њ –≤ –Ї–Њ–љ—В—А–∞—Б—В —Б –њ–∞–љ–Є–Ї–∞—В–∞, –Ї–Њ—П—В–Њ –Њ–±—Е–≤–∞–љ–∞ –і—А—Г–≥–Є —З–∞—Б—В–Є –Њ—В –µ–Ї–Њ—Б–Є—Б—В–µ–Љ–∞—В–∞ –љ–∞ –Њ—В–≤–Њ—А–µ–љ–Є—П –Ї–Њ–і.

–Ф–Њ—Б–µ–≥–∞ –≥–Њ–ї–µ–Љ–Є—В–µ –њ—А–Њ–µ–Ї—В–Є —Б–∞ –њ—А–Є–ї–∞–≥–∞–ї–Є –Ї–Њ—А–µ–љ–љ–Њ —А–∞–Ј–ї–Є—З–љ–Є –њ–Њ–і—Е–Њ–і–Є –Ї—К–Љ –≤—К–њ—А–Њ—Б–∞ –Ј–∞ –Є–Ј–Ї—Г—Б—В–≤–µ–љ–Є—П –Є–љ—В–µ–ї–µ–Ї—В. –Я—А–µ–Ј –њ–Њ—Б–ї–µ–і–љ–Є—В–µ –і–≤–µ –≥–Њ–і–Є–љ–Є –Є–Ј–≤–µ—Б—В–љ–Є –і–Є—Б—В—А–Є–±—Г—Ж–Є–Є –љ–∞ Linux –Ї–∞—В–Њ Gentoo, –Ї–∞–Ї—В–Њ –Є —Г—В–≤—К—А–і–µ–љ–∞—В–∞ Unix –і–Є—Б—В—А–Є–±—Г—Ж–Є—П NetBSD –њ—А–µ–і–њ—А–Є–µ—Е–∞ —Б—В—К–њ–Ї–Є –Ј–∞ –њ—К–ї–љ–∞ –Ј–∞–±—А–∞–љ–∞ –љ–∞ –Љ–∞—В–µ—А–Є–∞–ї–Є, –≥–µ–љ–µ—А–Є—А–∞–љ–Є –Њ—В –Ш–Ш. –Я–Њ–і–і—К—А–ґ–∞—Й–Є—В–µ NetBSD –Њ–њ–Є—Б–∞—Е–∞ —А–µ–Ј—Г–ї—В–∞—В–Є—В–µ –Њ—В –≥–Њ–ї–µ–Љ–Є—В–µ –µ–Ј–Є–Ї–Њ–≤–Є –Љ–Њ–і–µ–ї–Є (LLM) –Ї–∞—В–Њ —О—А–Є–і–Є—З–µ—Б–Ї–Є „–Ј–∞–Љ—К—А—Б–µ–љ–Є“ –њ–Њ—А–∞–і–Є –љ–µ—П—Б–љ–Є—П —Б—В–∞—В—Г—В –љ–∞ –∞–≤—В–Њ—А—Б–Ї–Є—В–µ –њ—А–∞–≤–∞ –≤—К—А—Е—Г –і–∞–љ–љ–Є—В–µ –Ј–∞ –Њ–±—Г—З–µ–љ–Є–µ –љ–∞ –Љ–Њ–і–µ–ї–Є—В–µ.

–Т –Њ—Б–љ–Њ–≤–∞—В–∞ –љ–∞ —В–∞–Ј–Є –њ–∞–љ–Є–Ї–∞ —Б—В–Њ–Є –°–µ—А—В–Є—Д–Є–Ї–∞—В—К—В –Ј–∞ –њ—А–Њ–Є–Ј—Е–Њ–і –љ–∞ —А–∞–Ј—А–∞–±–Њ—В—З–Є–Ї–∞ (DCO). –Ъ–∞–Ї—В–Њ Red Hat –њ–Њ—Б–Њ—З–Є –≤ –Ј–∞–і—К–ї–±–Њ—З–µ–љ –∞–љ–∞–ї–Є–Ј –≤ –Ї—А–∞—П –љ–∞ –Љ–Є–љ–∞–ї–∞—В–∞ –≥–Њ–і–Є–љ–∞, DCO –Є–Ј–Є—Б–Ї–≤–∞ —Е–Њ—А–∞—В–∞ –і–∞ —Г–і–Њ—Б—В–Њ–≤–µ—А—П—В —О—А–Є–і–Є—З–µ—Б–Ї–Є, —З–µ –Є–Љ–∞—В –њ—А–∞–≤–Њ –і–∞ –њ–Њ–і–∞–≤–∞—В —Б–≤–Њ—П –Ї–Њ–і. –Ґ—К–є –Ї–∞—В–Њ LLM —Б–∞ –Њ–±—Г—З–µ–љ–Є –љ–∞ –Њ–≥—А–Њ–Љ–љ–Є –Љ–∞—Б–Є–≤–Є –Њ—В –і–∞–љ–љ–Є —Б –Њ—В–≤–Њ—А–µ–љ –Ї–Њ–і, –Ї–Њ–є—В–Њ —З–µ—Б—В–Њ –љ–Њ—Б–Є –Њ–≥—А–∞–љ–Є—З–Є—В–µ–ї–љ–Є –ї–Є—Ж–µ–љ–Ј–Є –Ї–∞—В–Њ GNU General Public License, —А–∞–Ј—А–∞–±–Њ—В—З–Є—Ж–Є—В–µ, –Є–Ј–њ–Њ–ї–Ј–≤–∞—Й–Є Copilot –Є–ї–Є ChatGPT, –љ–µ –Љ–Њ–≥–∞—В –і–∞ –≥–∞—А–∞–љ—В–Є—А–∞—В –Є—Б—В–Є–љ—Б–Ї–Є –њ—А–Њ–Є–Ј—Е–Њ–і–∞ –љ–∞ —В–Њ–≤–∞, –Ї–Њ–µ—В–Њ –њ–Њ–і–∞–≤–∞—В. Red Hat –њ—А–µ–і—Г–њ—А–µ–і–Є, —З–µ —В–Њ–≤–∞ –Љ–Њ–ґ–µ –љ–µ–≤–Њ–ї–љ–Њ –і–∞ –љ–∞—А—Г—И–Є –ї–Є—Ж–µ–љ–Ј–Є—В–µ –Ј–∞ –Њ—В–≤–Њ—А–µ–љ –Ї–Њ–і –Є –љ–∞–њ—К–ї–љ–Њ –і–∞ —А–∞–Ј—А—Г—И–Є —А–∞–Љ–Ї–∞—В–∞ –љ–∞ DCO.

–Ю—Б–≤–µ–љ –њ—А–∞–≤–љ–Є—В–µ –≥–ї–∞–≤–Њ–±–Њ–ї–Є—П, –њ–Њ–і–і—К—А–ґ–∞—Й–Є—В–µ –њ—А–Њ–µ–Ї—В–Є—В–µ —Б—К—Й–Њ –≤–Њ–і—П—В –Ј–∞–≥—Г–±–µ–љ–∞ –±–Є—В–Ї–∞ —Б—А–µ—Й—Г –Њ–≥—А–Њ–Љ–љ–Є—П –Њ–±–µ–Љ. –°–≤–µ—В—К—В –љ–∞ –Њ—В–≤–Њ—А–µ–љ–Є—П –Ї–Њ–і –≤ –Љ–Њ–Љ–µ–љ—В–∞ —Б–µ –і–∞–≤–Є –≤ —В–Њ–≤–∞, –Ї–Њ–µ—В–Њ –Њ–±—Й–љ–Њ—Б—В—В–∞ –љ–∞—А–µ—З–µ AI slop. –°—К–Ј–і–∞—В–µ–ї—П—В –љ–∞ cURL —В—А—П–±–≤–∞—И–µ –і–∞ –њ—А–µ–Ї—А–∞—В–Є –њ—А–Њ–≥—А–∞–Љ–∞—В–∞ –Ј–∞ –љ–∞–≥—А–∞–і–Є –Ј–∞ –Њ—В–Ї—А–Є–≤–∞–љ–µ –љ–∞ –±—К–≥–Њ–≤–µ, —Б–ї–µ–і –Ї–∞—В–Њ –±–µ—И–µ –Ј–∞–ї—П—В —Б —Е–∞–ї—О—Ж–Є–љ–Є—А–∞–љ –Ї–Њ–і, –∞ –њ—А–Њ–µ–Ї—В–Є –Ї–∞—В–Њ Node.js –Є OCaml –њ–Њ–ї—Г—З–Є—Е–∞ –Њ–≥—А–Њ–Љ–љ–Є –њ–∞—З–Њ–≤–µ, –≥–µ–љ–µ—А–Є—А–∞–љ–Є –Њ—В –Ш–Ш, –Ї–Њ–µ—В–Њ –њ—А–µ–і–Є–Ј–≤–Є–Ї–∞ –µ–Ї–Ј–Є—Б—В–µ–љ—Ж–Є–∞–ї–љ–Є –і–µ–±–∞—В–Є —Б—А–µ–і –њ—А–Њ–≥—А–∞–Љ–Є—Б—В–Є—В–µ.

–Ъ—Г–ї—В—Г—А–љ–Њ—В–Њ –љ–∞–њ—А–µ–ґ–µ–љ–Є–µ, —Б–≤—К—А–Ј–∞–љ–Њ —Б –љ–µ—А–∞–Ј–Ї—А–Є—В–Є—П –Ї–Њ–і, —Б—К–Ј–і–∞–і–µ–љ –Њ—В –Ш–Ш, —Б–µ –Њ–Ї–∞–Ј–∞ –Њ—Й–µ –њ–Њ-–Њ–ґ–µ—Б—В–Њ—З–µ–љ–Њ. –Т –Ї—А–∞—П –љ–∞ –Љ–Є–љ–∞–ї–∞—В–∞ –≥–Њ–і–Є–љ–∞ –Є–љ–ґ–µ–љ–µ—А—К—В –Њ—В NVIDIA –Є –Њ—В–≥–Њ–≤–Њ—А–љ–Є–Ї –Ј–∞ –њ–Њ–і–і—А—К–ґ–Ї–∞—В–∞ –љ–∞ —П–і—А–Њ—В–Њ –°–∞—И–∞ –Ы–µ–≤–Є–љ —Б–µ —Б–±–ї—К—Б–Ї–∞ —Б –Љ–∞—Б–Є–≤–љ–∞ –љ–µ–≥–∞—В–Є–≤–љ–∞ —А–µ–∞–Ї—Ж–Є—П –Њ—В —Б—В—А–∞–љ–∞ –љ–∞ –Њ–±—Й–љ–Њ—Б—В—В–∞, —Б–ї–µ–і –Ї–∞—В–Њ —Б—В–∞–љ–∞ —П—Б–љ–Њ, —З–µ –µ –њ–Њ–і–∞–ї –њ–∞—З –Ј–∞ —П–і—А–Њ 6.15, –Є–Ј—Ж—П–ї–Њ –љ–∞–њ–Є—Б–∞–љ –Њ—В –≥–Њ–ї—П–Љ –µ–Ј–Є–Ї–Њ–≤ –Љ–Њ–і–µ–ї (LLM), –±–µ–Ј –і–∞ –≥–Њ –њ–Њ—Б–Њ—З–Є, –≤–Ї–ї—О—З–Є—В–µ–ї–љ–Њ –Є –≤ —Б–њ–Є—Б—К–Ї–∞ —Б –њ—А–Њ–Љ–µ–љ–Є—В–µ. –Т—К–њ—А–µ–Ї–Є —З–µ –Ї–Њ–і—К—В –±–µ—И–µ —Д—Г–љ–Ї—Ж–Є–Њ–љ–∞–ї–µ–љ, —В–Њ–є –і–Њ–≤–µ–і–µ –і–Њ –≤–ї–Њ—И–∞–≤–∞–љ–µ –љ–∞ –њ—А–Њ–Є–Ј–≤–Њ–і–Є—В–µ–ї–љ–Њ—Б—В—В–∞, –≤—К–њ—А–µ–Ї–Є —З–µ –±–µ—И–µ –њ—А–µ–≥–ї–µ–і–∞–љ –Є —В–µ—Б—В–≤–∞–љ. –Ю–±—Й–љ–Њ—Б—В—В–∞ —Б–µ –њ—А–Њ—В–Є–≤–Њ–њ–Њ—Б—В–∞–≤–Є –Ї–∞—В–µ–≥–Њ—А–Є—З–љ–Њ –љ–∞ –Є–і–µ—П—В–∞ —А–∞–Ј—А–∞–±–Њ—В—З–Є—Ж–Є—В–µ –і–∞ —Б–ї–∞–≥–∞—В –Є–Љ–µ–љ–∞—В–∞ —Б–Є –≤—К—А—Е—Г —Б–ї–Њ–ґ–µ–љ –Ї–Њ–і, –Ї–Њ–є—В–Њ –≤—Б—К—Й–љ–Њ—Б—В –љ–µ —Б–∞ –љ–∞–њ–Є—Б–∞–ї–Є, –Є –і–Њ—А–Є –Ґ–Њ—А–≤–∞–ї–і—Б –њ—А–Є–Ј–љ–∞, —З–µ –њ–∞—З—К—В –љ–µ –µ –±–Є–ї –њ—А–µ–≥–ї–µ–і–∞–љ –Ї–∞–Ї—В–Њ —В—А—П–±–≤–∞ –Њ—В—З–∞—Б—В–Є –Ј–∞—Й–Њ—В–Њ –љ–µ –µ –±–Є–ї –Њ–±–Њ–Ј–љ–∞—З–µ–љ –Ї–∞—В–Њ –≥–µ–љ–µ—А–Є—А–∞–љ –Њ—В –Ш–Ш.

–°–љ–Є–Љ–Ї–∞: Unsplash/Linux Kernel Project