OpenAI тества своята мултимодална версия на GPT-4 с поддръжка на разпознаване на изображения преди планираното широко разпространение. Според доклад на New York Times обаче публичният достъп е ограничен поради опасения относно способността й да разпознава конкретни лица.

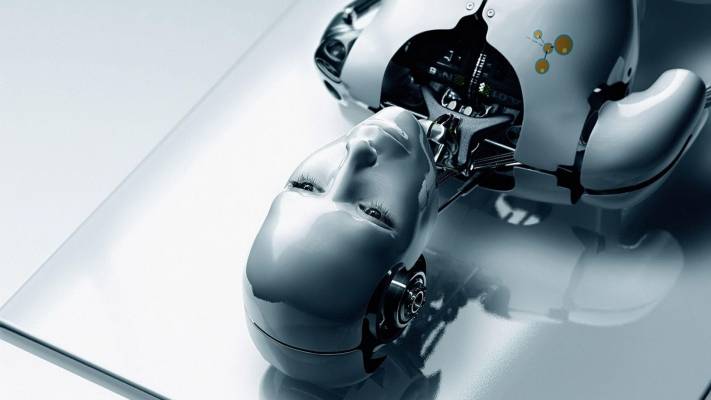

Когато OpenAI обяви GPT-4 по-рано тази година, компанията изтъкна мултимодалните възможности на модела на ИИ. Това означаваше, че моделът може не само да обработва и генерира текст, но и да анализира и интерпретира изображения, което открива ново измерение на взаимодействие с AI модела.

След съобщението OpenAI направи още една стъпка напред в своите способности за обработка на изображения в сътрудничество със стартъп, наречен Be My Eyes, който разработва приложение за описване на изображения нa потребители със зрителни проблеми, като им помага да интерпретират заобикалящата ги среда и да взаимодействат със света по-независимо.

В доклада на New York Times се изтъква опитът на Джонатан Мосен, потребител със зрителни затруднения на Be My Eyes от Нова Зеландия. Мосен с удоволствие използва приложението, за да разпознава предмети в хотелска стая, като например дозатори за шампоан, и да тълкува точно изображенията. Въпреки това Мосен изрази разочарование, когато приложението наскоро спря да предоставя информация за лицата, показвайки съобщение, че лицата са били скрити от съображения за поверителност.

Сандхини Агарвал, изследовател на политиката на OpenAI, потвърди пред Times, че организацията е ограничила възможностите за разпознаване на лица на GPT-4 поради проблеми с поверителността. Понастоящем системата на OpenAI е способна да идентифицира публични личности, като например тези, които имат страница в Wikipedia, но OpenAI се опасява, че тази функция може да наруши законите за защита на личните данни в някои региони (като например Европа), където използването на биометрична информация изисква изрично съгласие от гражданите.

Освен това OpenAI изрази притеснение, че Be My Eyes може да интерпретира или представи погрешно аспекти на лицата на хората, като пол или емоционално състояние, което да доведе до неподходящи или вредни резултати. OpenAI има за цел да се справи с тези и други проблеми, свързани с безопасността, преди възможностите за анализ на изображения на GPT-4 да станат широко достъпни. Агарвал заяви пред Times: "Много ни се иска това да бъде двупосочен разговор с обществеността. Ако това, което чуем, е: "Всъщност ние не искаме нищо от това", това е нещо, което ние подкрепяме".

Въпреки тези предпазни мерки има и случаи на конфабулиране на GPT-4 или на фалшиви идентификации, което подчертава предизвикателството да се създаде полезен инструмент, който да не дава на слепите потребители неточна информация.

Междувременно Microsoft, основен инвеститор в OpenAI, тества ограничено внедряване на инструмента за визуален анализ в своя чатбот Bing с изкуствен интелект, който се основава на технологията GPT-4. Неотдавна Bing Chat беше забелязан в Twitter да решава CAPTCHA тестове, предназначени за отсяване на ботове, което също може да забави по-широкото пускане на функциите за обработка на изображения на Bing.

Google също наскоро въведе функции за анализ на изображения в своя чатбот Bard, който позволява на потребителите да качват снимки за разпознаване или обработка от Bard. При нашите тестове на функцията тя можеше да решава CAPTCHA, базирани на думи, макар и не всеки път перфектно. Някои услуги като Roblox вече използват много трудни CAPTCHA, вероятно за да изпреварят подобни подобрения в компютърното зрение.

Този вид компютърно зрение, задвижвано от изкуствен интелект, рано или късно може да се появи в устройствата на всички, но също така е ясно, че компаниите ще трябва да отработят усложненията, преди да станем свидетели на широко разпространение с минимално етично въздействие.

Снимки: Unsplash