Ю Такаги не можеше да повярва на очите си. Седейки сам на бюрото си в съботния следобед през септември, той наблюдава с възхищение как изкуственият интелект декодира мозъчната дейност на субекта, за да създаде изображения на това, което той вижда на екрана.

"Все още си спомням кога видях първите генерирани от изкуствен интелект изображения", казва пред Al Jazeera Такаги, 34-годишен невролог и доцент в университета в Осака. "Влязох в банята, погледнах се в огледалото, видях лицето си и си помислих: "Добре, това е нормално. Може би не полудявам".

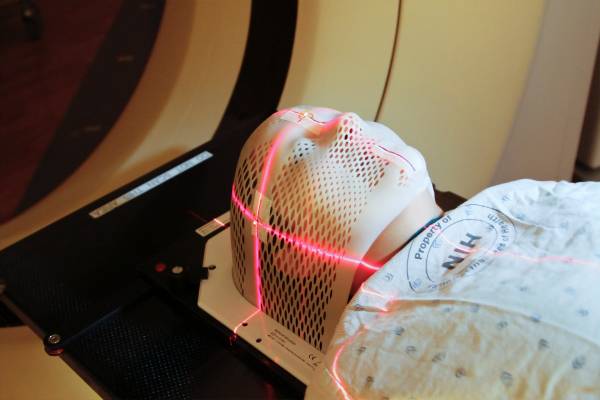

Такаги и екипът му използват Stable Diffusion (SD) - модел на изкуствен интелект с дълбоко обучение, разработен в Германия през 2022 г., за да анализират мозъчните сканирания на тестови субекти, на които са показани до 10 000 изображения, докато са в апарат за ядрено-магнитен резонанс.

След като Такаги и неговият партньор в изследването Шинджи Нишимото изградили прост модел за "превеждане" на мозъчната активност в разбираем формат, Stable Diffusion успял да генерира висококачествени изображения, които имали невероятна прилика с оригиналите.

Изкуственият интелект успя да направи това, въпреки че не му бяха показани предварително снимките и не беше обучен по никакъв начин да произвежда резултатите.

"Наистина не очаквахме такъв резултат", казва Такаги.

Такаги подчертава, че на този етап пробивът не представлява четене на мисли - изкуственият интелект може само да създава изображения, които човек е гледал.

"Това не е четене на мисли", казва Такаги. "За съжаление има много недоразумения с нашите изследвания." "Не можем да разкодираме въображения или сънища; смятаме, че това е твърде оптимистично. Но, разбира се, има потенциал в бъдеще."

Но въпреки това разработката породи опасения относно начина, по който подобна технология може да бъде използвана в бъдеще на фона на по-широкия дебат за рисковете, породени от ИИ като цяло.

В отворено писмо миналия месец технологични лидери, сред които основателят на Tesla Илон Мъск и съоснователят на Apple Стив Возняк, призоваха за спиране на развитието на ИИ поради "дълбоките рискове за обществото и човечеството".

Въпреки вълнението си Такаги признава, че опасенията, свързани с технологията за четене на мисли не са безпочвени, като се има предвид възможността за злоупотреба от страна на хора със злонамерени намерения или без съгласие.

"За нас въпросите, свързани с неприкосновеността на личния живот, са най-важни. Ако едно правителство или институция може да чете мислите на хората, това е много чувствителен въпрос", казва Такаги. "Необходимо е да се проведат дискусии на високо равнище, за да се гарантира, че това не може да се случи."

Снимка: Unsplash

Виж още: Интерактивните методи на образование - необходима стъпка от ново поколение