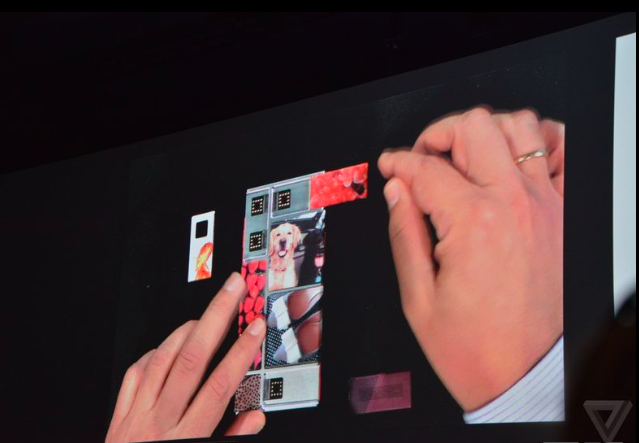

Google I/O 2015 –Ω―Ä–Η–≤–Μ–Β―΅–Β –≤–Ϋ–Η–Φ–Α–Ϋ–Η–Β―²–Ψ –Ϋ–Α –≤―¹–Η―΅–Κ–Η ―¹ –Φ–Ϋ–Ψ–≥–Ψ–±―Ä–Ψ–Ι–Ϋ–Η―²–Β ―¹–Η –Α–Ϋ–Ψ–Ϋ―¹–Η, –Ϋ–Ψ –Β–¥–Η–Ϋ –Ω―Ä–Ψ–Β–Κ―² –Ψ―¹―²–Α–Ϋ–Α –Φ–Α–Μ–Κ–Ψ –≤―¹―²―Ä–Α–Ϋ–Η –Ψ―² –Φ–Β–¥–Η–Ι–Ϋ–Η―è ―à―É–Φ. –ü–Ψ–¥―Ä–Α–Ζ–¥–Β–Μ–Β–Ϋ–Η–Β―²–Ψ Google ATAP (Advanced Technology and Projects) –Ϋ–Η –Ω―Ä–Β–¥―¹―²–Α–≤–Η Project Soli – –Β–¥–Η–Ϋ –Η–Ϋ―²–Β―Ä–Β―¹–Β–Ϋ –Φ–Β―²–Ψ–¥ –Ζ–Α –≤–Ζ–Α–Η–Φ–Ψ–¥–Β–Ι―¹―²–≤–Η–Β ―¹ ―É―¹―²―Ä–Ψ–Ι―¹―²–≤–Α –Ϋ–Η.

Project Soli ―â–Β –Ϋ–Α–Ω―Ä–Α–≤–Η ―²–Α–Κ–Α, ―΅–Β ―Ä―ä―Ü–Β―²–Β –Η –Ω―Ä―ä―¹―²–Η―²–Β –Ϋ–Η ―â–Β ―¹–Α –Β–¥–Η–Ϋ―¹―²–≤–Β–Ϋ–Η―è―² –Ω–Ψ―²―Ä–Β–±–Η―²–Β–Μ―¹–Κ–Η –Η–Ϋ―²–Β―Ä―³–Β–Ι―¹, –Ψ―² –Κ–Ψ–Ι―²–Ψ ―â–Β ―¹–Β –Ϋ―É–Ε–¥–Α–Β–Φ. –½–Α –¥–Α ―¹–Β ―¹–Μ―É―΅–Η ―²–Ψ–≤–Α, ―¹–Β –Η–Ζ–Ω–Ψ–Μ–Ζ–≤–Α ―Ä–Α–¥–Α―Ä, –Κ–Ψ–Ι―²–Ψ –Β –¥–Ψ―¹―²–Α―²―ä―΅–Ϋ–Ψ –Φ–Α–Μ―ä–Κ, –Ζ–Α –¥–Α ―¹–Β –Ω–Ψ–±–Β―Ä–Β –≤ ―É–¥–Ψ–±–Β–Ϋ –Ζ–Α –Ϋ–Ψ―¹–Β–Ϋ–Β ―É–Φ–Β–Ϋ ―΅–Α―¹–Ψ–≤–Ϋ–Η–Κ. –€–Α–Μ–Κ–Η―è―² ―Ä–Α–¥–Α―Ä ―É–Μ–Α–≤―è –¥–≤–Η–Ε–Β–Ϋ–Η―è –Ϋ–Η –≤ ―Ä–Β–Α–Μ–Ϋ–Ψ –≤―Ä–Β–Φ–Β –Η –≥–Η –Η–Ζ–Ω–Ψ–Μ–Ζ–≤–Α, –Ζ–Α –¥–Α ―Ä–Α–Ζ–±–Β―Ä–Β –Κ–Α–Κ–≤–Ψ –Ω―Ä–Α–≤–Η–Φ. –ö–Ψ–≥–Α―²–Ψ –Ω―Ä–Β–Φ–Β―¹―²–≤–Α–Φ–Β ―Ä―ä–Κ–Α―²–Α –Η–Μ–Η –Ω―Ä―ä―¹―²–Η―²–Β ―¹–Η, ―Ä–Α–¥–Α―Ä―ä―² –Ζ–Α―¹–Η―΅–Α ―¹–Η–≥–Ϋ–Α–Μ–Α –Η –Α–Φ–Ω–Μ–Η―²―É–¥–Α―²–Α –Η –Ω―Ä–Β–Ψ–±―Ä–Α–Ζ―É–≤–Α ―²–Ψ–≤–Α –≤ –Κ–Ψ–Φ–Α–Ϋ–¥–Α, –Η–Ζ–Ω―ä–Μ–Ϋ―è–≤–Α―â–Α ―¹–Β –Ϋ–Α ―É―¹―²―Ä–Ψ–Ι―¹―²–≤–Ψ―²–Ψ. –Δ–Α–Κ–Α ―¹ –Β–¥–Ϋ–Ψ ―â–Η–Ω–≤–Α–Ϋ–Β –Ϋ–Α–Ω―Ä–Η–Φ–Β―Ä ―â–Β –Φ–Ψ–Ε–Β –¥–Α –Ψ―²–≤–Α―Ä―è–Φ–Β –Ω―Ä–Η–Μ–Ψ–Ε–Β–Ϋ–Η―è. –û―² ATAP ―â–Β –Ψ―¹–Η–≥―É―Ä―è―² APIs –Ζ–Α –Ω–Ψ-–¥―ä–Μ–±–Ψ–Κ–Ψ –Φ–Α―à–Η–Ϋ–Ϋ–Ψ –Ψ–±―É―΅–Β–Ϋ–Η–Β –Ϋ–Α Project Soli. –£–Η–Ε―²–Β –Η –≤–Η–¥–Β–Ψ―²–Ψ:

–ü―Ä–Ψ―΅–Β―²–Β―²–Β –Ψ―â–Β: Google Spotlight Stories –≤–Β―΅–Β –Η –≤ YouTube